この記事のPodcast

下記のPodcastは、Geminiで作成しました。

はじめに

現在、私たちの生活に欠かせない存在となった大規模言語モデル(LLM)は、膨大な情報を処理し、人間のように自然な対話を行うことができます。しかし、AIが「より長く、より複雑な話」を理解しようとすると、実は「記憶の限界」という大きな技術等障壁に直面します。この問題を解決するために登場した革新的な技術が「TriAttention(トライ・アテンション)」です。本レポートでは、AIがどのようにして情報を取捨選択し、記憶しているのかという基礎から、TriAttentionがどのようにしてAIの記憶効率を10倍以上に高めたのかという最新の研究成果までを、専門的な知見に基づきつつ、初心者の方にも分かりやすく解説します。

AIの「注目」と「記憶」のメカニズム

AIが文章を読んだり、画像を認識したりする際に、最も重要な役割を果たすのが「注意機構(アテンション・メカニズム)」と呼ばれる技術です 。これは、人間が複雑な景色の中から特定の対象に目を向けたり、騒がしいパーティーの中で特定の人の声を聞き取ったりするのと同様に、AIも入力されたデータの中から「今、どこに注目すべきか」を動的に判断する仕組みを指します 。

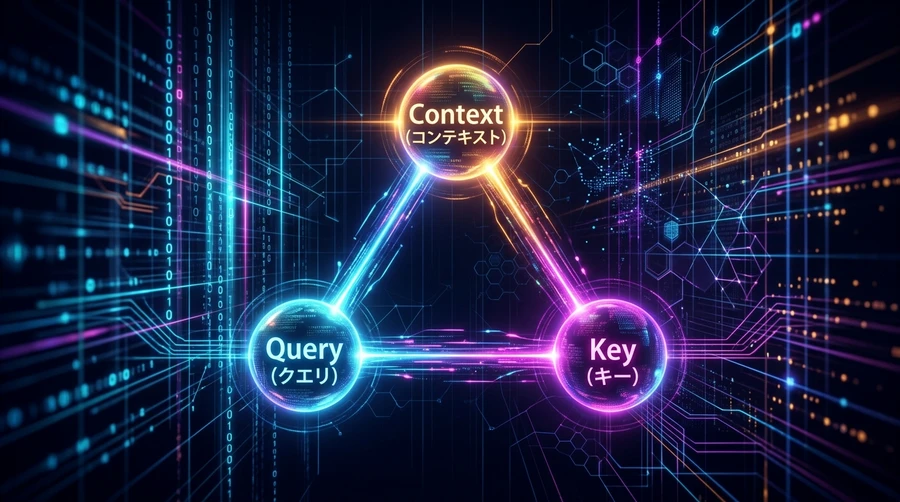

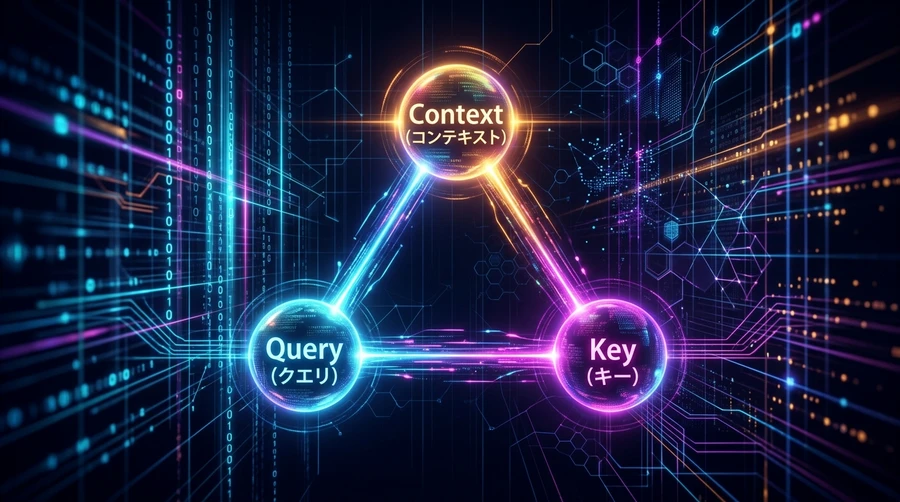

注意機構の基本要素:Q、K、V

AIのアテンション計算では、情報を3つの役割に分けて管理します 。

- クエリ(Query/Q): 「今、何を探しているか」という検索窓に入力するキーワードのような情報です。

- キー(Key/K): データベースに保存されている情報の「ラベル」や「見出し」に相当します。

- バリュー(Value/V): その情報が持つ「中身」そのものです。

AIはクエリ(探し物)とキー(見出し)の相性を計算し、相性が良いもののバリュー(中身)を強く反映させることで、文脈に沿った回答を生成します 。この一連のやり取りを繰り返すことで、AIは「彼」という代名詞が数行前の「太郎君」を指しているといった、言葉のつながりを理解できるようになります 。

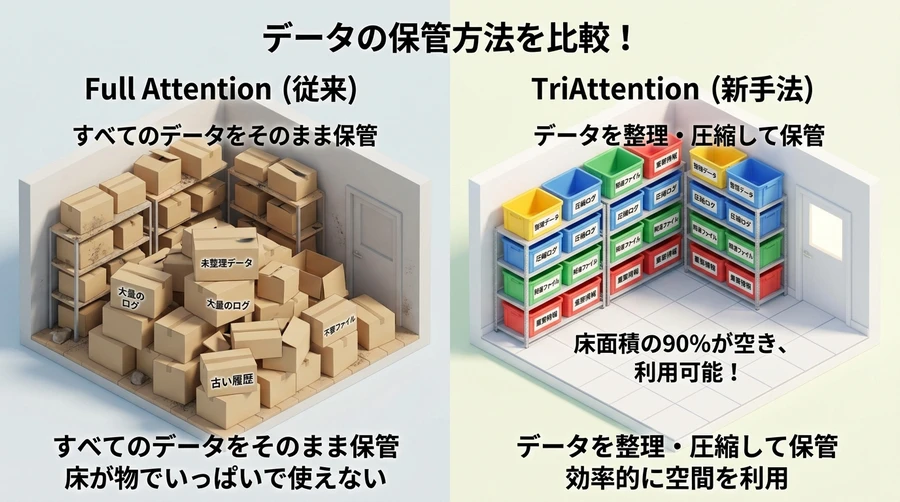

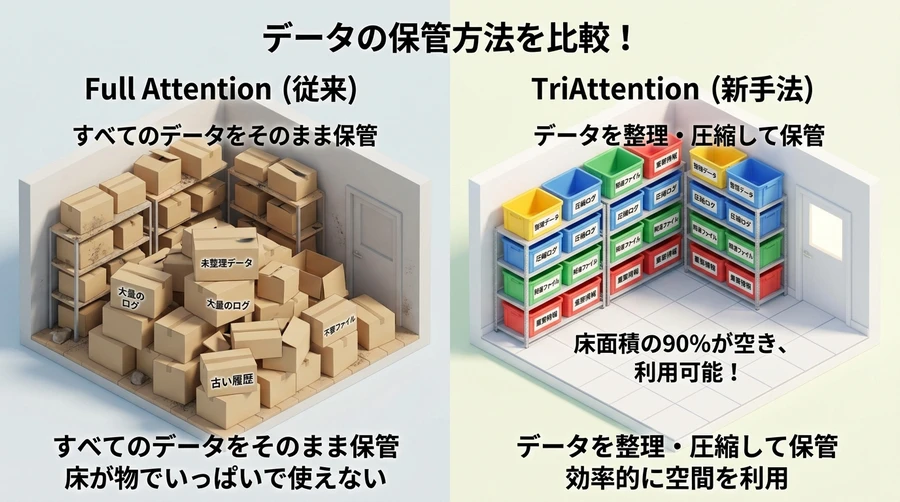

長い対話における「記憶のボトルネック」

AIとの会話が長くなると、AIは過去の会話内容(キーとバリューのセット)をすべて「KVキャッシュ」というメモリスペースに溜め込んでいきます 。しかし、この記憶スペースは会話の長さに比例して膨らんでいくため、最終的にはコンピューターのメモリ(作業台)を使い果たし、動作が遅くなったり、エラーで止まったりしてしまいます 。これが、現在のAIが「超長文」を扱う際の一大障壁となっています。

表1:標準的なアテンションと記憶の課題

| 項目 | 内容 | 影響 |

| 処理単位 | クエリ、キー、バリュー | 1対1のペア関係を重視 |

| 記憶形式 | KVキャッシュ | データ量が線形に増加 |

| 限界 | メモリ消費の増大 | 長い推論や複雑な作業が困難 |

| 既存の対策 | 過去の記憶を捨てる(削減) | 重要な情報を失い、推論が破綻する |

TriAttention:二次元から「三次元」の対話へ

TriAttention、あるいは広義の「Trilinear Attention(三次元アテンション)」は、これまで主流だった2つの要素(クエリとキー)の相互作用だけでなく、3つ目の要素を加えた「三者間」のやり取りをモデル化する技術です 。

三次元アテンションの概念

従来のアテンションが「質問と資料」の2点間で重要度を決めていたのに対し、TriAttentionはそこに「文脈(コンテキスト)」や「他のモダリティ(画像や音など)」を明示的に組み込みます 。これにより、単なる1対1の照合よりも豊かな、高次の関係性を捉えることが可能になります 。

NLP(自然言語処理)の分野では、以下の4つのようなTri-Attentionのバリエーションが研究されてきました 。

- T-Additive(加算型): クエリ、キー、コンテキストを足し合わせてから重みを計算します。

- T-Dot-Product(内積型): 3つの情報を掛け合わせて関連度を算出します。

- T-Scaled-Dot-Product(スケール付き内積型): 計算結果が大きくなりすぎないよう調整を加えた形式です。

- Full Trilinear(完全三次元型): 3つの要素すべての組み合わせを高度な数式(テンソル)で処理します。

これらの手法を用いることで、AIはより複雑な「物事の背景」を考慮した回答ができるようになります 。

2026年のブレイクスルー:MIT・NVIDIA・ZJUによるTriAttention

2026年、マサチューセッツ工科大学(MIT)、NVIDIA、浙江大学(ZJU)の研究チームは、AIの記憶問題を劇的に解決する新しい「TriAttention」を発表しました 。この研究は、特にLLMが長い推論を行う際のメモリ不足を解消することに特化しており、業界に大きな衝撃を与えました。

「回転」する前のデータに隠された秘密

最近の高性能AIは、言葉の位置を理解するために「RoPE(回転位置埋め込み)」という技術を使ってデータを回転させています 。しかし、この回転のせいで「どの記憶が重要か」の判断が難しくなり、効率的な記憶の整理ができないという問題がありました 。

研究チームは、データが回転される前の空間「Pre-RoPE(プレ・ロープ)」を分析しました。すると驚くべきことに、クエリ(Q)とキー(K)のベクトルが特定の中心点にギュッと集中している(Q/K Concentration)という性質を発見したのです 。この性質は、AIが解いている問題の内容に関わらず、モデルそのものが持つ「固有の癖」のようなものです 。

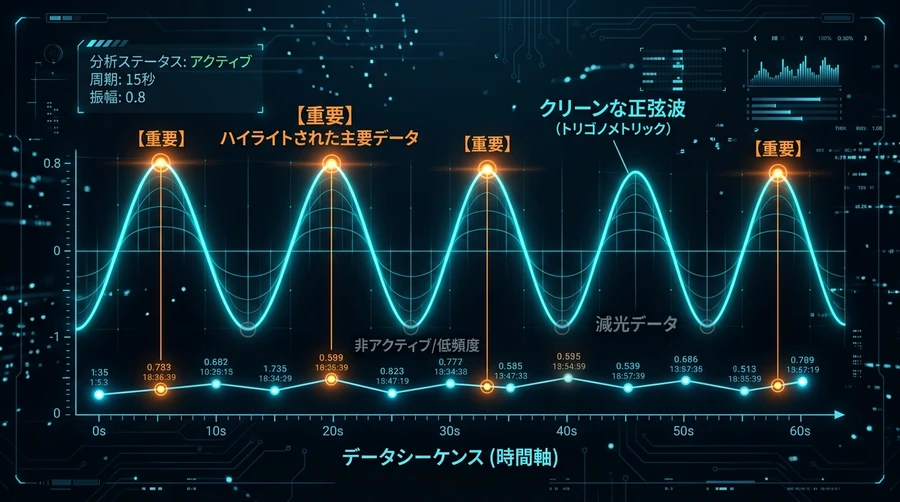

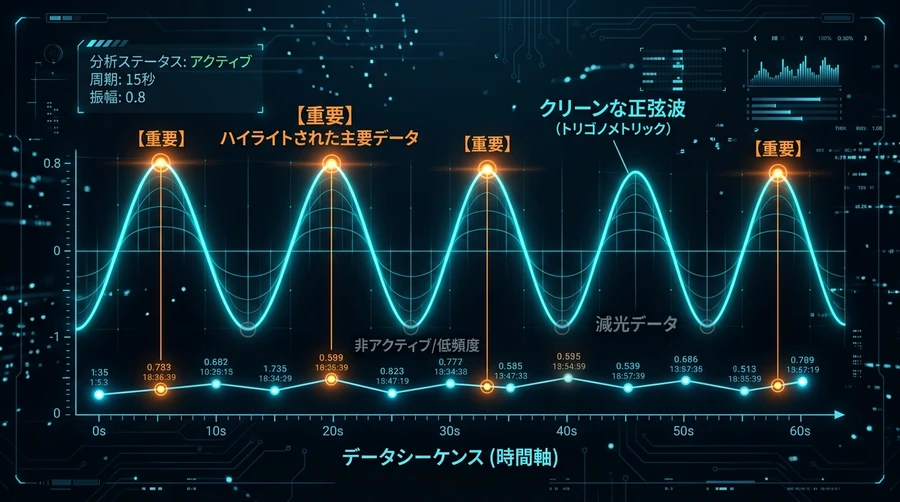

三角関数による「未来の注目」の予言

この「データの集中」を利用すれば、AIが次にどこに注目するかを、数学的な「波(三角関数)」を使って予測することができます 。 具体的には、以下のような「三角級数(Trigonometric Series)」の数式を用いて、各情報の重要度をスコアリングします 。

$$S_{\text{trig}}(k, \Delta) = \sum_{f} \|E[q_f]\| \cdot \|k_f\| \cdot \cos(\omega_f \Delta + \phi_f)$$

ここで、$\Delta$は言葉と言葉の距離を表します。つまり、AIは実際に計算を行う前に、「この距離にある言葉は、後で重要になるはずだ」ということを波の計算だけで予言し、重要な情報だけを記憶に残して、不要な情報を捨てることができるようになったのです 。

TriAttentionがもたらす圧倒的な性能向上

TriAttentionの導入により、AIの性能は従来の限界を大きく超える数値を示しました 。特に、難解な数学の問題を解くテスト(AIME25)や、長文の理解度を測るテストにおいて、驚異的な結果を残しています。

記憶容量の劇的な削減とスピードアップ

TriAttentionは、従来の「すべての記憶を保持する」方法と同じ精度を保ちながら、記憶に必要なメモリ(KVキャッシュ)を最大で10.7倍も削減することに成功しました 。これは、これまで大規模なサーバーセンターでしか動かせなかったような巨大なAIが、私たちの手元にある一般的なPCのビデオカード(RTX 4090など)でも動かせるようになることを意味します 。

また、不要な情報を処理しなくて済むため、AIが回答を生成するスピード(スループット)も約2.5倍に向上しています 。

表2:TriAttentionと従来手法の性能比較(Qwen3-8Bモデルによる検証)

| 評価指標 | フル・アテンション(圧縮なし) | 従来手法 (R-KV) | TriAttention |

| 数学問題正解率 (AIME25) | 40.8% | 17.5% | 32.9% ~ 40.8% |

| KVキャッシュ削減率 | 1.0x (基準) | 10.7x | 10.7x |

| スループット(秒間トークン数) | 222.8 | - | 563.5 |

| 推論の安定性 | 非常に高い | 低い(忘却が発生) | 非常に高い |

多様な分野への広がり:画像、動画、そしてロボット

TriAttentionの技術は、文章の処理だけでなく、視覚情報や身体的な動きの認識など、あらゆるAIの分野に応用されています 。

視覚と動画の理解

画像認識の分野では、「Trilinear Attention Sampling Network (TASN)」という技術が、鳥の羽の模様といった微細な特徴を見分けるのに役立っています 。これは、画像の中の「場所」と「色の特徴(チャネル)」の相互作用を三次元的に分析することで、人間のように細かな違いに気づく仕組みです 。

また、最新の動画生成AI「Sora」や「LongLive」においても、時間と空間を同時に捉えるアテンション技術が重要視されています 。TriAttentionを動画生成に応用することで、メモリ不足で難しかった「長時間の動画」でも、キャラクターの姿や背景が途中で変わることなく、一貫性を保って生成できるようになります 。

人間の動きを捉える「スケルトン認識」

スポーツ解析や介護ロボットの分野では、人間の関節の動き(スケルトンデータ)を分析して「今、何をしているか」を当てる技術に使われています 。 ここでも、

- 関節同士の関係(空間)

- 時間の経過による動き(時間)

- 動きの強さや変化(ダイナミクス) これら3つの要素を「Tri-attentionモジュール」で統合することで、非常に高い精度で動作を認識することが可能になります 。

表3:TriAttentionの応用分野とメリット

| 分野 | 技術の名称 | 主なメリット |

| 文章 (NLP) | 2026年型 TriAttention | 記憶の10倍削減、超長文推論の安定化 |

| 画像認識 | TASN, Triplet Attention | 細かなパーツの識別精度向上 |

| 動画生成 | LongLive + TriAttention | 長尺動画の一貫性維持、メモリ節約 |

| 動作認識 | STAEGCN, Tri-Attention | スポーツや介護での行動検知精度の向上 |

| マルチモーダル | CTI (VQA) | 画像と質問を組み合わせて賢く回答 |

実装と将来展望:AIが「手の届く存在」へ

TriAttentionは単なる理論にとどまらず、すでに多くの開発者が利用できる形で公開されています。GitHub上で公開されているコードや、llama.cppといった軽量な実行環境への移植により、AMDのGPUやAppleのM1/M2/M3/M4チップを搭載したMacでも、驚くほど高速に動作することが報告されています 。

OpenClawとの連携

「OpenClaw」というAIエージェントの基盤では、TriAttentionがデフォルトで活用されています 。これにより、大量の指示書を読み込ませてもAIがメモリ不足(OOM)で止まることがなくなり、複雑なプログラミング作業やリサーチ作業を数時間にわたって継続できるようになりました 。

将来のAI像:ローカル推論の進化

TriAttentionのような「効率化」技術の進化は、プライバシーの観点からも重要です 。巨大なクラウドサーバーにデータを送らなくても、自分自身のパソコン(ローカル環境)で、機密性の高い書類をAIに解析させたり、自分専用の高度な知識を持つ「AIパートナー」を育てたりすることが現実のものとなります 。

結論

TriAttentionは、AIが「より賢く、より速く、より身近に」なるための鍵となる技術です 。 2次元的なペアのやり取りから、文脈や背景を含めた3次元的な対話へと進化したことで、AIは人間により近い「深い洞察」と、膨大な情報を瞬時に整理する「優れた記憶術」を手に入れました 。 この技術によって、AIの「記憶の壁」は過去のものとなり、私たちのポケットの中やデスクの上にあるデバイスが、世界中の知識を自在に操る強力な知性へと変貌を遂げようとしています 。

参考資料

- Trilinear attention mechanisms, https://www.emergentmind.com/topics/trilinear-attention-mechanisms

- TriAttention AI definition mechanism, https://arxiv.org/html/2604.04921v1

- Attention mechanism, https://www.ibm.com/think/topics/attention-mechanism

- What is Attention Mechanism?, https://hai.stanford.edu/ai-definitions/what-is-attention-mechanism

- What is an Attention Mechanism?, https://h2o.ai/wiki/attention-mechanism/

- TriAttention paper summary, https://www.alphaxiv.org/overview/2604.04921

- TriAttention: Efficient Long Reasoning with Trigonometric KV Compression, https://www.researchgate.net/publication/403562159_TriAttention_Efficient_Long_Reasoning_with_Trigonometric_KV_Compression

- TriAttention: A KV Cache Compression Method That Matches Full Attention at 2.5× Higher Throughput, https://www.marktechpost.com/2026/04/11/researchers-from-mit-nvidia-and-zhejiang-university-propose-triattention-a-kv-cache-compression-method-that-matches-full-attention-at-2-5x-higher-throughput/

- Triangular Attention Mechanism, https://www.emergentmind.com/topics/triangular-attention-mechanism

- Attention mechanism in deep learning, https://www.activeloop.ai/resources/glossary/attention-mechanism/

- Tri-AI Face Detection and Recognition, https://pmc.ncbi.nlm.nih.gov/articles/PMC7415925/

- Deep Generative Models for Medical Image Augmentation, https://pmc.ncbi.nlm.nih.gov/articles/PMC10144738/

- Video action recognition via spatiotemporal attention, https://www.informatica.si/index.php/informatica/article/view/6188/3314

- Self-attention breakthrough in Transformers, https://en.wikipedia.org/wiki/Attention_(machine_learning

- Attention vs. Self-Attention in Transformers, https://www.geeksforgeeks.org/nlp/attention-vs-self-attention-in-transformers/

- Attention vs. Self-Attention Differences, https://www.baeldung.com/cs/attention-self-badhanau-differences

- Difference between attention and self-attention, https://www.reddit.com/r/LanguageTechnology/comments/be6jfc/what_is_the_difference_between_self_attention_and/

- How does Sora generate video from text?, https://milvus.io/ai-quick-reference/how-does-sora-generate-video-from-text

- Sora OpenAI's Video Model Architecture, https://www.allpcb.com/allelectrohub/sora-openais-video-model-architecture-and-use-cases

- Sora Intuitively and Exhaustively Explained, https://towardsdatascience.com/sora-intuitively-and-exhaustively-explained-a54f83ea9c21/

- Attention Redundancy in Video DiTs, https://arxiv.org/html/2408.12588v1

- Neural Computers and Video-Based Prototypes, https://www.marktechpost.com/2026/04/12/meta-ai-and-kaust-researchers-propose-neural-computers-that-fold-computation-memory-and-i-o-into-one-learned-model/?amp

- Everything that happened in AI this week April 2026, https://www.theneuron.ai/explainer-articles/around-the-horn-digest-everything-that-happened-in-ai-this-week-monday-wednesday-april-6-8-2026/

- Guide to AI Video Memes and Mayhem with Sora 2, https://www.theneuron.ai/explainer-articles/your-complete-guide-to-ai-video-memes-and-mayhem-with-openais-sora-2/

- From Zero to Codex Hero: OpenAI's Coding Agent, https://www.theneuron.ai/explainer-articles/from-zero-to-codex-hero-everything-you-need-to-know-about-openais-coding-agent/

- Everything OpenAI Released on DevDay 2025 Explained, https://www.theneuron.ai/explainer-articles/everything-openai-released-on-devday-2025-explained/

- Trilinear Attention for Visual Question Answering, https://www.emergentmind.com/topics/trilinear-attention-mechanism

- How do attention mechanisms work in multimodal AI models, https://milvus.io/ai-quick-reference/how-do-attention-mechanisms-work-in-multimodal-ai-models

- The importance of attention mechanisms, https://www.ibm.com/think/topics/attention-mechanism

- Attention from first principles to production, https://medium.com/@lepicardhugo/attention-from-first-principles-to-production-the-fundamentals-def39bee8f46

- Tri-CLT for Multimodal Sentiment Analysis, https://pdfs.semanticscholar.org/79ea/eef90300fb7434449546d397c61b1ddf9e4a.pdf

- TriAttention mechanism leverages Q/K concentration, https://www.alphaxiv.org/overview/2604.04921

- 3D-GENERALIST Vision-Language-Action Models, https://research.nvidia.com/publication/2026-03_3d-generalist-vision-language-action-models-crafting-3d-worlds

- TriAttention: Efficient Long-Context Reasoning, https://www.reddit.com/r/MachineLearning/comments/1serby2/r_triattention_efficient_kv_cache_compression_for/

- TriAttention GitHub Repository, https://github.com/WeianMao/triattention

- Recursive Language Models for Long-Horizon Agents, https://www.marktechpost.com/2026/01/02/recursive-language-models-rlms-from-mits-blueprint-to-prime-intellects-rlmenv-for-long-horizon-llm-agents/

- TriAttention Efficient Long Reasoning with Trigonometric KV Compression, https://github.com/WeianMao/triattention

- TriAttention KV cache compression for memory-efficient long video generation, https://github.com/NVlabs/LongLive/issues/50

- NVlabs/LongLive GitHub Issues, https://github.com/NVlabs/LongLive/issues

- Awesome LLM Long Context Modeling, https://github.com/Xnhyacinth/Awesome-LLM-Long-Context-Modeling/blob/main/README.md

- Systematic Exploration of KV Cache Compression Techniques, https://huggingface.co/papers?q=KV%20cache%20compression

- Tri-Attention Explicit Context-Aware Attention Mechanism for NLP, https://www.researchgate.net/publication/365189154_Tri-Attention_Explicit_Context-Aware_Attention_Mechanism_for_Natural_Language_Processing

- GTAN tri-attention network innovations, https://huggingface.co/papers?q=attention-based%20neural%20network

- Spatiotemporal Graph Networks for Campus Infrastructure Management, https://www.researchgate.net/publication/397058470_Spatiotemporal_Graph_Networks_for_Relational_Reasoning_in_Campus_Infrastructure_Management

- Fully 1x1 Convolutional Network for Lightweight Image Super-resolution, https://www.researchgate.net/publication/383316997_Fully_1_1_Convolutional_Network_for_Lightweight_Image_Super-resolution

- Self-Attention mechanisms for long-term temporal dependencies, https://ecai2023.eu/acceptedpapers

- TriAttention matches Full Attention at 2.5x higher throughput, https://www.marktechpost.com/2026/04/11/researchers-from-mit-nvidia-and-zhejiang-university-propose-triattention-a-kv-cache-compression-method-that-matches-full-attention-at-2-5x-higher-throughput/

- Researchers from MIT NVIDIA and ZJU propose TriAttention, https://www.reddit.com/r/OpenSourceeAI/comments/1situnz/researchers_from_mit_nvidia_and_zhejiang/

- TriAttention: Efficient Long-Context Reasoning, https://www.reddit.com/r/MachineLearning/comments/1serby2/r_triattention_efficient_kv_cache_compression_for/

- NVIDIA Releases Nemotron 3 Super with high throughput, https://www.marktechpost.com/2026/03/11/nvidia-releases-nemotron-3-super-a-120b-parameter-open-source-hybrid-mamba-attention-moe-model-delivering-5x-higher-throughput_for-agentic-ai/

- Multimodal reasoning fundamental to human problem-solving, https://arxiv.org/html/2501.05444v1

- Large Multimodal Reasoning Models table, https://github.com/HITsz-TMG/Awesome-Large-Multimodal-Reasoning-Models

- Multimodal AI Use Cases Every Enterprise Should Know, https://www.nexgencloud.com/blog/case-studies/multimodal-ai-use-cases-every-enterprise-should-know

- How Multimodal Reasoning AI Differs from Unimodal, https://ajithp.com/2025/04/21/multimodal-reasoning-ai/

- TriAttention scores keys leveraging centers, https://arxiv.org/html/2604.04921v1

- Trigonometric wave predicting AI reasoning, https://www.youtube.com/watch?v=U4z-tqV9MTM

- Decision-Relevant Selection (DRS) algorithm, https://www.arxiv.org/list/cs/new?skip=875&show=1000

- Functional heterogeneity in reasoning models, https://huggingface.co/papers?q=KV%20cache%20compression

- RoFormer: Enhanced transformer with RoPE, https://www.researchgate.net/publication/375900997_RoFormer_Enhanced_transformer_with_Rotary_Position_Embedding

- llama.cpp port of TriAttention benchmarks, https://github.com/ggml-org/llama.cpp/discussions/21619

- Alex discusses TriAttention research paper, https://www.youtube.com/watch?v=X4XIOja_NU4

- TriAttention vs H2O vs SnapKV comparison stats, https://www.marktechpost.com/2026/04/11/researchers-from-mit-nvidia-and-zhejiang-university-propose-triattention-a-kv-cache-compression-method-that-matches-full-attention-at-2-5x-higher-throughput/

- SnapKV achieves consistent decoding speed, https://arxiv.org/pdf/2404.14469

- Spatio-temporal attention graph convolution network (STAEGCN), https://www.fujipress.jp/jaciii/jc/jacii002800061367/

- Skeleton data and spatiotemporal features, https://pmc.ncbi.nlm.nih.gov/articles/PMC12608129/

- Deep learning-based skeletal action modeling survey, https://arxiv.org/html/2506.00915v1

- Federated learning for skeleton-based action recognition, https://www.mdpi.com/1424-8220/25/23/7277

- Trainable temporal attention for action recognition, https://neurips.cc/virtual/2022/57539

- Tri-Attention Explicit Context-Aware Attention Mechanism, https://www.researchgate.net/publication/365189154_Tri-Attention_Explicit_Context-Aware_Attention_Mechanism_for_Natural_Language_Processing

- Attention-gated multimodal deep features for video streaming, https://www.researchgate.net/publication/337875478_Porn_Streamer_Recognition_in_Live_Video_Streaming_via_Attention-Gated_Multimodal_Deep_Features

- Illegal website identification based on tri-training, https://www.mdpi.com/2079-9292/13/11/2199

- Attention Mechanism (AM) in video image processing, https://www.informatica.si/index.php/informatica/article/view/6188/3314

- Multimodal applications of LLMs and tokenization, https://pmc.ncbi.nlm.nih.gov/articles/PMC11456558/

- Pre-RoPE Q/K Vector Concentration Analysis, https://arxiv.org/html/2604.04921v1

- Trigonometric Series Scoring and Periodic Pruning, https://www.alphaxiv.org/overview/2604.04921

- Decision-Relevant Concepts and State Abstraction, https://www.arxiv.org/list/cs/new?skip=875&show=1000

- TriAttention Efficient Long Reasoning with Trigonometric KV, https://huggingface.co/papers/2604.04921

- Weekly AI Newsletter April 2026 News, https://medium.com/nlplanet/anthropics-glasswing-project-with-mythos-weekly-ai-newsletter-april-13th-2026-c846ba5c16ec

コメント