【2025年最新】FramePack Studio完全ガイド:低VRAMで高品質AI動画を生成!使い方からインストールまで初心者向けに徹底解説のPodcast

下記のPodcastは、Geminiで作成しました。

ストーリーブック

はじめに

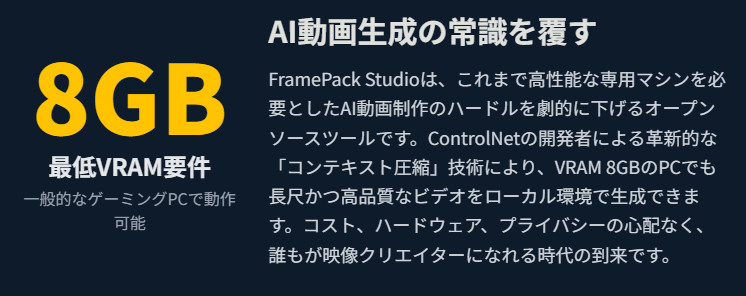

AIによる動画生成は、かつては高性能な専用マシンや高額なクラウドサービスを必要とする、一部の専門家のための領域でした 。多くのクリエイターが「AIで動画を作ってみたい」と思っても、NVIDIA RTX 4090のようなハイエンドGPUの壁や、生成できる動画の短さ、一貫性のなさに直面し、そのポテンシャルを十分に引き出せずにいました。しかし、2025年、その常識を覆す画期的なツールが登場しました。それが「FramePack Studio」です。

FramePack Studioは、無料で利用できるオープンソースのAI動画生成アプリケーションであり、一般的なゲーミングPCでも長尺かつ高品質なビデオをローカル環境で制作することを可能にします 。このツールの根幹にあるのは、AI画像生成の世界に革命をもたらした「ControlNet」の開発者としても知られるLvmin Zhang氏が発表した革新的な「FramePack」技術です 。ControlNetが画像生成における構図の制御を民主化したように、FramePack技術はビデオ生成におけるハードウェアと動画尺の制約という大きな壁を取り払うことを目指しています。本記事では、このFramePack Studioの全貌を、技術的な背景から具体的なインストール方法、実践的な使い方、さらには高度なテクニックに至るまで、AI動画生成が初めての方にも分かりやすく、丁寧に解説します。

FramePack Studioとは?創造性を解き放つテクノロジーの核心

FramePack Studioを理解するためには、まずその中核をなす「FramePack」技術と、それを誰でも使えるようにしたアプリケーションである「FramePack Studio」の関係性を知ることが重要です。

エンジンと車体:FramePack技術とFramePack Studio

- FramePack技術: これは、論文として発表された革新的なニューラルネットワークアーキテクチャ、いわば高性能な「エンジン」です 。その最大の特徴は、ビデオ生成プロセスにおけるメモリ使用量を劇的に削減する技術にあります。

- FramePack Studio: これは、その強力なエンジンを搭載し、誰もがコードを書くことなく直感的に操作できるグラフィカル・ユーザー・インターフェース(GUI)を備えたアプリケーション、つまり「車体」です 。このアプリケーションの登場により、専門家でなくともFramePack技術の恩恵を受けられるようになりました。

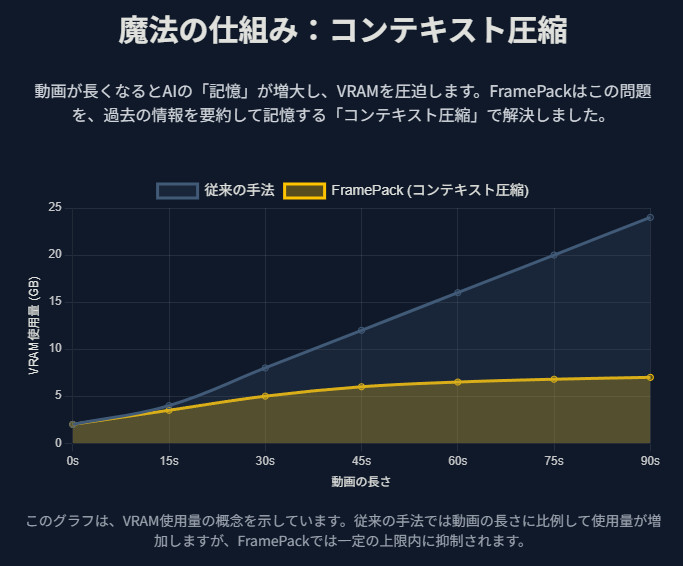

魔法の仕組み:「コンテキスト圧縮」が低VRAMでの長尺動画を可能にする理由

FramePackの革新性は、「次フレーム予測」と「コンテキスト圧縮」という2つの技術に集約されます 。

次フレーム予測とは、AIが直前のフレーム群を参考に、まるで人間のアニメーターが次のコマを描くように、動画の続きを予測して生成していく仕組みです 。しかし、単純にこれを続けると、動画が長くなるにつれてAIが記憶すべき過去のフレーム情報が増大し、GPUのメモリ(VRAM)を瞬く間に使い果たしてしまいます。これが「忘却」問題であり、従来のローカルAI動画生成ツールが数秒の動画しか作れなかった主な原因です 。

ここで登場するのがコンテキスト圧縮です。これは、AIの記憶の仕方を効率化する画期的なアプローチです。人間が記憶する際に、直近の出来事は鮮明に覚えている一方で、遠い過去の出来事は要点だけを覚えているのに似ています。FramePackは、直近のフレームは高解像度で詳細に記憶し、古くなるにつれてフレーム情報を段階的に圧縮して「要約」として保持します 。これにより、動画全体の文脈(コンテキスト)を失うことなく、メモリ使用量を一定の上限内に抑えることができるのです。

この技術的ブレークスルーの結果、わずか8GB程度のVRAMを搭載した一般的なGPUでも、1分を超えるような長尺動画の生成が可能になりました。これは、ローカル環境でのAI動画制作における革命と言えるでしょう 。

AI動画界の地図:FramePack Studioの位置付け

FramePack Studioがどのような立ち位置にあるのかを理解するために、他の主要なAI動画生成ツールと比較してみましょう。

| ツール名 | 主要プラットフォーム | コストモデル | 対象ユーザー | 主な利点 |

| FramePack Studio | ローカル | 無料(オープンソース) | 初心者〜中級クリエイター | 消費者向けGPUでの長尺動画生成 |

| ComfyUI | ローカル | 無料(オープンソース) | 上級者・技術者 | ノードベースによる究極の柔軟性と拡張性 |

| Runway (Gen-3/4) | クラウド | サブスクリプション | プロのクリエイター | 高度な映像制御と統合された編集ツール |

| Pika Labs | クラウド | フリーミアム/サブスクリプション | SNSクリエイター | 使いやすさと強力なスタイルエフェクト |

| OpenAI Sora | クラウド | サブスクリプション | 一般ユーザー | 最高のリアリズムとプロンプト追従性(アクセス制限あり) |

この表からわかるように、FramePack Studioは「無料で」「自分のPC上で動作し」「初心者でも扱いやすい」という、これまでありそうでなかった独自のポジションを確立しています。クラウドサービスの利便性やComfyUIの無限のカスタマイズ性とは異なる、「アクセシビリティ」と「パワフルさ」を両立させたツールなのです。

創造的な制御をその手に:FramePack Studioの主要機能詳解

FramePack Studioが単なる技術デモではなく、真のクリエイティブツールである理由は、その多彩で実用的な機能群にあります。これらの機能は、単に映像を生成するだけでなく、物語を語るための基本的な要素を提供します 。

タイムスタンプ付きプロンプトによる動的な物語の演出

これはFramePack Studioの最も強力な機能の一つです。1つの動画クリップの中で、時間経過と共にプロンプト(指示文)を変化させることができます 。例えば、「0秒地点:夜明けの静かな野原に立つ騎士」というプロンプトから始まり、「5秒地点:騎士が剣を抜くと、空に暗雲が立ち込める」というように、シーンの展開やキャラクターの行動を時間軸に沿って細かく指定できます。さらにプロンプトブレンディング機能を使えば、プロンプト間の変化が急なカットにならず、滑らかで映画的なトランジションとして表現されます 。

LoRAサポートによるキャラクターとスタイルの一貫性

AI動画生成における長年の課題は「キャラクターの一貫性」でした。同じキャラクターを別のシーンで登場させようとすると、顔や服装が微妙に変わってしまう問題です。FramePack Studioは、LoRA (Low-Rank Adaptation) と呼ばれる技術をサポートすることで、この問題を解決します。LoRAとは、特定のキャラクターや画風を学習させた小さな「スタイルファイル」のようなものです。これを適用することで、生成される動画全体で一貫したキャラクターやアートスタイルを維持することが可能になります 。特に、FramePack StudioはHunyuan Video LoRAとの互換性が高く、多くのコミュニティ製LoRAを利用できます 。

あらゆるニーズに応える多彩な生成モード

FramePack Studioは、複数の生成モードを提供し、様々な制作ニーズに対応します 。

- Original / F1モデル: これらはFramePackモデルの異なるバージョンで、特にF1モデルはよりダイナミックで動きのある映像を生成する傾向があります 。

- Video Extension: 既存の動画クリップの続きを、元の映像の動きやスタイルを維持したまま自然に生成する非常に実用的な機能です。短いショットを違和感なく延長したい場合に威力を発揮します 。

効率的で整理されたワークフロー

- キューシステム: 複数の生成タスク(ジョブ)をあらかじめ登録しておき、順番に自動実行させることができます。これにより、PCの前で待ち続けることなく、夜間などにまとめて生成を行うといった効率的な作業が可能になります 。

- メタデータ保存/インポート: プロンプト、シード値、各種パラメータなど、生成に使用したすべての設定がJSONファイルとして自動保存されます。後からこのファイルを読み込むだけで、過去の作品を完全に再現したり、設定を微調整して新しいバリエーションを作成したりできます 。

- カスタムプリセット: よく使うパラメータの組み合わせを名前を付けて保存できます。これにより、実験的な設定や定番のスタイルなどを瞬時に切り替えることができ、試行錯誤のプロセスが大幅に高速化します 。

これらの機能群は、FramePack Studioが単なる「動画生成器」ではなく、変化するシーン、一貫したキャラクター、再現可能なスタイルといった、物語を構築するための要素を備えた「ストーリーテラーのためのツールキット」であることを示しています。

始めよう:初心者のためのステップ・バイ・ステップ導入ガイド

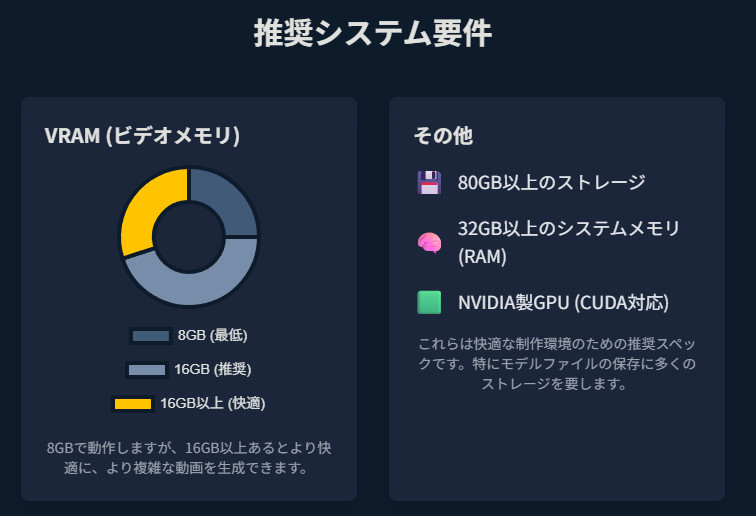

FramePack Studioを始める前に、お使いのPCが要件を満たしているか確認しましょう。これが、快適なAI動画制作への第一歩です。

準備運動:システム要件の確認

ユーザーが導入でつまずかないよう、必要なハードウェア要件を明確に示します 。

- GPU: CUDAに対応したNVIDIA製GPUが必須です。

- VRAM(ビデオメモリ): 最低8GB、16GB以上を強く推奨します。

- システムメモリ(RAM): 最低16GB、32GB以上を強く推奨します。

- ストレージ: 80GB以上の空き容量が必要です(モデルファイルの保存に大容量を要します)。

【重要:Windowsユーザー向け】ページファイル設定の確認

FramePack Studioは動画生成中に多くのメモリを消費します。物理メモリが不足した場合に処理がクラッシュするのを防ぐため、Windowsの「ページファイル(仮想メモリ)」のサイズを十分に確保することが強く推奨されます。

- Windowsの検索バーで「システムの詳細設定の表示」を検索して開きます。

- 「パフォーマンス」セクションの「設定」をクリックし、「詳細設定」タブに移動します。

- 「仮想メモリ」セクションの「変更」をクリックします。

- 「すべてのドライブのページング ファイルのサイズを自動的に管理する」のチェックを外し、Cドライブを選択後、「カスタムサイズ」を選びます。

- 「初期サイズ」と「最大サイズ」の両方に、搭載している物理RAMの1.5倍から2倍程度の値をMB単位で入力します(例:32GB RAMなら48000MB)。

- 「設定」ボタンを押してPCを再起動します。この一手間が、後の安定した動作に繋がります。

ステップ1:必須ツールのインストール

FramePack Studioを動かすには、いくつかの基本的なツールが必要です。

- Gitのインストール: プログラムのソースコードをダウンロードするために「Git」というツールが必要です。公式サイト(https://git-scm.com/)からダウンロードし、インストーラーの指示に従ってインストールしてください。ほとんどの設定はデフォルトのままで問題ありません。

-

Python 3.10 (64-bit)のインストール: FramePack Studioは特定のバージョンのPythonで動作します。

- こちらのPython公式サイトから、「Windows installer (64-bit)」をダウンロードします。32-bit版ではないことを必ず確認してください。

- インストーラーを起動したら、【非常に重要】 画面の一番下にある 「Add Python 3.10 to PATH」というチェックボックスに必ずチェックを入れてください。

- チェックを入れたら、「Install Now」をクリックしてインストールを完了させます。

ステップ2:FramePack Studioのダウンロード

次に、FramePack Studio本体のファイルをPCにダウンロードします。

- Windowsのスタートメニューで「cmd」と検索し、「コマンドプロンプト」を起動します。

-

FramePack Studioをインストールしたいドライブに移動します。例えばDドライブにインストールしたい場合は、

D:と入力してEnterキーを押します。 -

以下のコマンドをコピー&ペーストしてEnterキーを押し、ファイルをダウンロードします。

git clone https://github.com/FP-Studio/framepack-studio.gitこれで、指定したドライブに

framepack-studioというフォルダが作成されます。

ステップ3:専用環境の構築と部品(ライブラリ)のインストール

PC内の他のプログラムに影響を与えないよう、FramePack Studio専用の安全な「仮想環境」を作成し、必要な部品をインストールします。

-

フォルダに移動: コマンドプロンプトで、先ほど作成されたフォルダに移動します。

cd framepack-studio -

仮想環境の作成: 以下のコマンドで、Python 3.10を使った専用の作業スペース(仮想環境)を作成します。

py -3.10 -m venv venv -

仮想環境の有効化: 以下のコマンドで、作成した作業スペースに入ります。

.\venv\Scripts\activate成功すると、コマンドプロンプトの行の先頭に`(venv)`と表示されます。 -

AIの心臓部(PyTorch GPU版)をインストール: 最も重要な部品である、GPUの性能を引き出すためのAIエンジンをインストールします。

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121 残りの部品をインストール: 最後に、その他の必要な部品をリストから一括でインストールします。

pip install -r requirements.txtこの処理はPCの性能やネットワーク速度によって数分から数十分かかる場合がありますが、正常な動作です。

ステップ4:初回起動と利便性の向上

すべての準備が整いました。いよいよFramePack Studioを起動します。

-

初回起動: コマンドプロンプトで

(venv)が表示されている状態で、以下のコマンドを入力してEnterキーを押します。run.bat - 【最重要注意点】モデルファイルの自動ダウンロード: 初回起動時に、FramePack Studioは動作に必須の巨大なモデルファイル(数十GB)のダウンロードを自動的に開始します。このダウンロードは数十分から数時間かかる場合があり、その間プログラムは応答しないように見えます。ここでプロセスを強制終了すると、ファイルが破損し、インストールが失敗する原因となります。 完了するまで絶対に中断せず、辛抱強く待ちましょう。

-

アクセス: 起動が完了すると、コマンドプロンプトに

Running on local URL: http://0.0.0.0:7860と表示されます。ウェブブラウザを開き、アドレスバーにhttp://127.0.0.1:7860と入力すると、操作画面が表示されます。 -

利便性の向上(推奨): 毎回URLを入力する手間を省き、ブラウザを自動で開くように

run.batファイルを編集します。-

エクスプローラーで

D:\framepack-studio(インストールした場所)を開き、run.batファイルを右クリックして「編集」を選択します。 - メモ帳で開かれたファイルの中身をすべて削除し、以下の内容に書き換えて上書き保存します。

コード スニペット@echo off echo Starting FramePack-Studio... echo. echo The application will be available at: http://127.0.0.1:7860 echo Your browser will open automatically once the server is ready. echo Please keep this window open to use the application. echo. call.\venv\Scripts\activate python studio.py --inbrowser pause -

エクスプローラーで

今後の使い方

次回以降、FramePack Studioを使う際は、以下の手順で簡単に起動できます。

-

コマンドプロンプトを開き、

cd D:\framepack-studioのようにインストールしたフォルダに移動します。 -

.\venv\Scripts\activateで仮想環境に入ります。 -

run.batを実行します。ブラウザが自動で開きます。

最初のアニメーション:FramePack Studioを使ってみよう

インストールが完了したら、いよいよ最初のAI動画を生成してみましょう。インターフェースは直感的で、すぐに慣れることができます。

操作パネルの確認:メインUIの概要

FramePack Studioを起動すると、GradioベースのシンプルなUIが表示されます 。画面は大きく分けて、左側に設定エリア、右側に出力エリアが配置されています。

- 入力エリア: 開始画像(Image-to-Videoの場合)のアップロード、プロンプトの入力欄があります。

- パラメータエリア: 動画の長さや品質などを調整するスライダーや設定項目が並んでいます。

- 出力エリア: 生成された動画やプレビューが表示されます。

静止画から動画へ:Image-to-Video(I2V)チュートリアル

- FramePack Studioを起動します。

-

画像をアップロード: アニメーションの元にしたい画像(例:人物のポートレート)をドラッグ&ドロップします。

- プロンプトを記述: 画像に与えたい動きを簡単な英語で記述します。例:「The person slowly smiles and blinks.」(その人物はゆっくりと微笑み、まばたきをする。)

-

基本設定を調整:

- Total Video Length (seconds): 最初のテストとして、3〜5秒に設定します。

- Steps: AIの「思考回数」のようなものです。デフォルト値(例:25)のままで問題ありません。値を大きくすると品質が向上する可能性がありますが、生成時間も長くなります 。

- Seed: 生成されるランダム性の「ID番号」です。同じシード値と同じ設定を使えば、何度でも全く同じ結果を再現できます。

- 生成を開始: 「Generate」または「Add to Queue」ボタンをクリックします。

- 結果を確認: しばらく待つと、出力エリアにアニメーション化された動画が表示されます。

テキストから動画へ:Text-to-Video(T2V)

開始画像をアップロードせずにプロンプトだけで動画を生成することも可能です(T2V)。その際、Latent Image Options を使うことで、黒や白の無地、あるいは合成作業に便利なグリーンスクリーンから生成を開始することもできます 。

プロンプトに「"0": "A lone astronaut stands on the surface of a barren, red planet, looking at the distant Earth in a dark sky. Cinematic, still shot.",

"4": "Suddenly, a vibrant, swirling nebula begins to form in the sky, casting a purple and blue glow on the astronaut's helmet. The ground begins to tremble slightly.",

"8": "The nebula grows larger, stars streak across the sky like comets, the camera slowly zooms in on the astronaut's helmet, reflecting the cosmic spectacle."」と入れて生成した動画は以下の通り。

プロ品質を目指すための高度なテクニック

基本操作に慣れたら、より高度な機能を使って作品のクオリティを高めていきましょう。

タイムスタンプ付きプロンプトでシーンを演出する

この機能を使えば、一本の動画の中で物語を展開させることができます。正確な記法はドキュメントに明記されていませんが、GitHubのプルリクエスト(#73 "Prompt Segments")などから、以下のようなJSON形式に近い記法が一般的です 。

"0": "a beautiful woman standing in a sunny field, smiling",

"60": "the sky turns dark, the woman's expression becomes serious",

"90": "rain starts to fall, she looks up at the sky"

この例では、フレーム番号0(開始時)、60、90でプロンプトが切り替わります。プロジェクトは活発に開発されているため、最新の正確な記法については、公式のDiscordコミュニティやドキュメントで確認することをお勧めします。

プロンプトに「[0s: In the vibrant, sun-drenched expanse of a lush, golden field, a truly captivating woman stands, her radiant smile casting a warm glow upon her face. Her long, wavy auburn hair, resembling a cascading waterfall, sways gently in the breeze, framing her slender figure. She is adorned in a flowing white sundress, its lightweight fabric billowing around her, accentuating her graceful stature. Her eyes, a mesmerizing shade of emerald green, sparkle with joy and a gentle warmth, drawing the viewer's attention. In her hands, she holds a bouquet of sunflowers, their bright yellow petals a striking contrast against her fair skin. The field, bathed in the golden light of the sun, extends behind her, adorned with a riot of wildflowers in a myriad of hues. The shot is a medium long shot, capturing her from the waist up, her posture relaxed yet poised, as she basks in the sun's embrace, her presence embody][3s: The sky darkens ominously, transitioning from a vibrant azure to a deep, brooding indigo. Simultaneously, the woman's countenance shifts dramatically, her face now etched with grave concern, her eyes narrowed in thought, and her brows furrowed. Her posture becomes more rigid, shoulders slumping slightly, as if bearing an immense weight. The scene is set against a backdrop of a stormy evening, with swirling clouds casting ominous shadows. The camera captures this transformation from a medium long shot, gradually zoomed in to focus on the woman's face, emphasizing her internal turmoil.][5s: In a soft, melancholic scene, a young woman with a gentle expression turns her head towards the heavens as the first drops of rain begin to fall. She stands amidst a light drizzle, her hands lightly at her sides, palms facing upwards, as if absorbing the coolness of the approaching moisture. The raindrops cascade down, creating a rhythmic melody, while the woman's hair, a cascade of chestnut waves, gently sways with the breeze. The background is a blur of urban life, with tall buildings and bustling city streets, providing a stark contrast to the tranquil scene unfolding before her. The shot is a medium long shot, capturing the woman's contemplative pose and the evolving rainfall.]」と入れて生成した動画が下記の通り。

出来上がった動画を見ると、プロンプト通りの動画が再生されていないですね。

LoRAでキャラクターを固定する

キャラクターの一貫性を保つためにはLoRAの活用が不可欠です。

-

LoRAを探す: CivitaiやHugging Faceといったサイトで「Hunyuan Video LoRA」と検索し、使いたいキャラクターやスタイルのLoRAファイル(

.safetensors形式)を見つけます。 -

LoRAを配置する: ダウンロードしたファイルを、FramePack Studioの指定されたフォルダ(例:

models/loras)に配置します。 - LoRAを適用する: UI上のLoRA選択メニューから使いたいLoRAを選び、その影響の強さ(Weight)をスライダーで調整します。

このテクニックは、コミュニティでも活発に議論されており、キャラクターを固定(Character Locking)するための最も効果的な手法とされています 。

結論:AI動画制作の未来への扉

FramePack Studioは、AIによる動画制作のハードルを劇的に下げ、クリエイターの創造性を解放する強力なツールです。その核心的な価値は以下の点に集約されます。

- アクセシビリティ: 高価なハイエンドGPUを必要とせず、一般的なPCで動作します。

- 経済性: 無料のオープンソースソフトウェアであり、月額費用は一切かかりません。

- 創造的な制御: タイムスタンプ付きプロンプトやLoRAサポートにより、単なる映像生成を超えた物語性の高い作品作りを可能にします。

- プライバシー: 全ての処理がローカルPC上で完結するため、データが外部に送信される心配がありません。

このプロジェクトは現在も活発に開発が続けられており、世界中のユーザーコミュニティからのフィードバックによって日々進化しています 。技術的なハードルに臆することなく、ぜひPinokioを使ってFramePack Studioをインストールし、あなた自身のアイデアを映像にしてみてください。公式のDiscordサーバーに参加すれば、他のクリエイターと作品を共有したり、分からないことを質問したりすることもできます。FramePack Studioは、誰もが映像作家になれる時代の幕開けを告げる、未来への扉なのです。

参考資料

- FramePack Studio Official GitHub Repository, https://github.com/FP-Studio/framepack-studio

- FramePack (Original Technology) GitHub Repository, https://github.com/lllyasviel/FramePack

- FramePack Studio Official Documentation, https://docs.framepackstudio.com/

- Pinokio AI Browser (Recommended Installer), https://pinokio.computer/

- FramePack Research Paper, https://arxiv.org/abs/2504.12626

- ComfyUI-FramePackWrapper (for ComfyUI users), https://github.com/kijai/ComfyUI-FramePackWrapper

コメント