- AIの長文読解に革命?清華大学発「Glyph」の仕組みを初心者向けに徹底解説 - テキストを画像化する新発想のPodcast

- ストーリーブッhttps://open.spotify.com/episode/7I2RfZSF7OFZ2aUWC9EbqD?si=ulDPpJjORq--A1eseULCHgク

- はじめに:「テキストの壁」問題と新たな解決策

- Glyphとは何か?視覚的テキスト圧縮という核心概念

- thu-coai/Glyphを支える技術

- 「Glyph」ファミリー:視覚テキストAIの全体像を理解する

- 根本原因:なぜAIはテキストの扱いが苦手なのか?

- 限界と今後の可能性

- 結論:AIとテキストの新たな関係性の幕開け

- 参考資料

AIの長文読解に革命?清華大学発「Glyph」の仕組みを初心者向けに徹底解説 - テキストを画像化する新発想のPodcast

下記のPodcastは、Geminiで作成しました。

ストーリーブッhttps://open.spotify.com/episode/7I2RfZSF7OFZ2aUWC9EbqD?si=ulDPpJjORq--A1eseULCHgク

「グリフのふしぎなものがたり:AIのアルビー、よみかきをまなぶ」の絵本を見る

はじめに:「テキストの壁」問題と新たな解決策

現代のAI技術、特に大規模言語モデル(LLM)は、人間のように自然な文章を生成し、複雑な対話を行う能力で世界を驚かせています。しかし、その驚異的な能力にもかかわらず、LLMには根本的な弱点が存在します。それは、非常に長い文章、いわゆる「テキストの壁」を効率的に処理できないという問題です。数万語に及ぶ学術論文、分厚い法律文書、あるいは大規模なソフトウェアのコードベース全体を一度に理解させることは、現在の技術では極めて困難です。

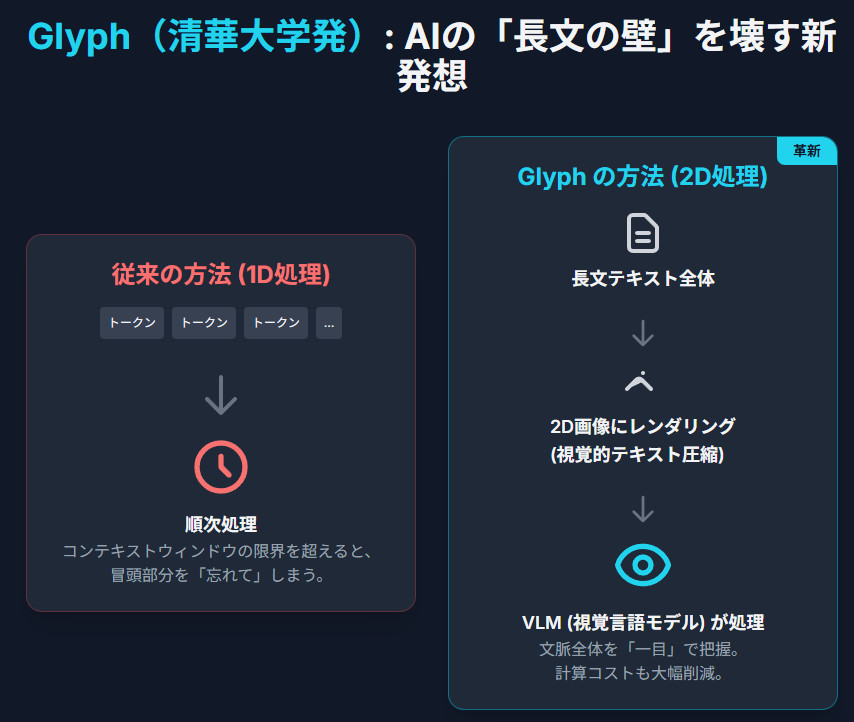

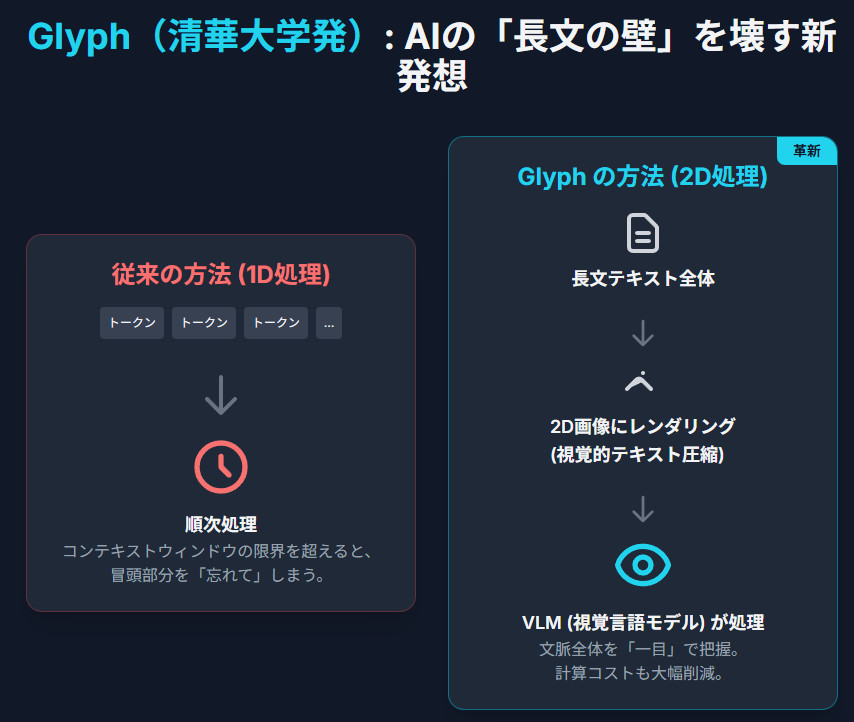

この問題の根源には、「コンテキストウィンドウ」と呼ばれるLLMが一度に処理できるテキストの長さに上限があることが挙げられます。この上限を超えると、モデルは文章の冒頭部分を「忘れて」しまい、文脈全体を捉えた正確な応答ができなくなります。コンテキストウィンドウを拡張する試みは続けられていますが、テキストが長くなるにつれて計算量とメモリ使用量が爆発的に増加する「注意機構(Attention Mechanism)」の構造的な制約が、大きな障壁となっています。

この根深い課題に対し、中国の名門、清華大学の研究チームが全く新しいアプローチを提案しました。それが、本稿で詳説する「Glyph」フレームワークです 1。Glyphは、トークンベースのコンテキストウィンドウを無理に拡張するのではなく、問題の捉え方そのものを変革します。その核心的なアイデアは、「AIに長いテキストトークンの列を一つずつ読ませるのではなく、テキスト全体が書かれた『画像』を見せたらどうなるか?」という、まさに発想の転換です。

ただし、AIの世界で「Glyph」という名前は複数の異なる、しかし重要なプロジェクトで使われているため、混乱が生じやすい点に注意が必要です。本稿では、主に清華大学が開発した長文コンテキスト理解のためのthu-coai/Glyphに焦点を当てますが、同時に、画像生成AIが苦手とする「画像内に正確な文字を描画する」技術であるGlyph-ByT5など、他の「Glyph」ファミリーについても後ほど詳しく解説し、その関係性と全体像を明らかにします。

Glyphとは何か?視覚的テキスト圧縮という核心概念

thu-coai/Glyphの革新性を理解するためには、「視覚的テキスト圧縮(Visual-Text Compression)」という中心的な概念を把握する必要があります。これは、従来のLLMがテキストを処理する方法とは根本的に異なるアプローチです。

アナロジーで理解するGlyphの仕組み

Glyphの仕組みを直感的に理解するために、簡単なアナロジーを考えてみましょう。友人に長編小説の物語を伝える場面を想像してください。

従来のLLMのアプローチは、小説の物語を最初から最後まで一語一語、口頭で友人に聞かせるようなものです。友人の短期記憶には限界があるため(これがコンテキストウィンドウに相当)、物語が長くなるにつれて、序盤の重要な伏線や登場人物を忘れてしまいます。

一方、Glyphのアプローチは、小説の全ページを高解像度カメラで撮影し、その写真を収めたアルバムを友人に渡すようなものです。この場合、友人は視覚言語モデル(Vision-Language Model, VLM)として機能します。VLMは、アルバムを一目で見渡すことで、物語の全体像、つまりすべての文脈を一度に把握することができます。個々の単語を順番に記憶する必要はなく、ページ全体のレイアウトやテキストの配置といった視覚情報から、必要な情報を効率的に探し出すことができるのです。

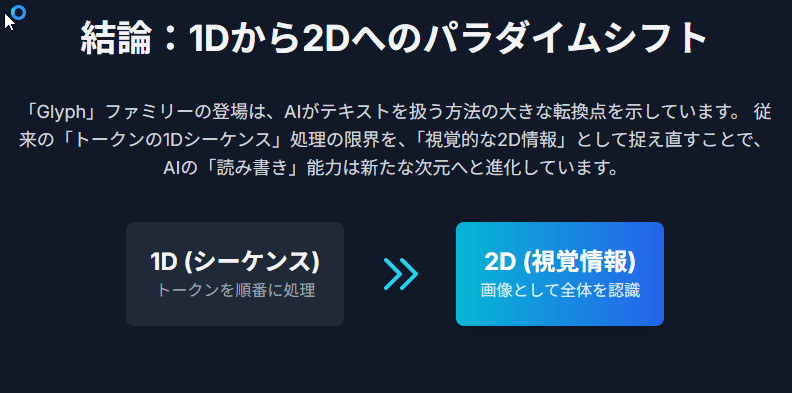

1次元から2次元への転換

このアナロジーが示すように、Glyphは技術的に大きな転換を行っています。テキストは、本質的にトークン(単語や文字の一部)が直線的に並んだ「1次元」のシーケンスデータです。Glyphは、この1次元のテキストシーケンスを、コンパクトな「2次元」の画像にレンダリング(描画)します 1。入力データの次元を変えるこのプロセスが、劇的な効率化の鍵となります。

効率化が実現される理由

なぜテキストを画像に変換すると効率が上がるのでしょうか。その理由は主に二つあります。

-

圧倒的な圧縮率:

一枚の画像は、数千、場合によっては数万のテキストトークンを表現することが可能です。例えば、Glyphは平均して3倍から4倍の入力圧縮率を達成します 1。これは、モデルが処理しなければならない入力トークンの総数を劇的に削減することを意味します。計算コストの多くは入力長に依存するため、この圧縮は非常に効果的です。 -

「Prefill」ステージの最適化:

LLMが長いプロンプトを処理する際、最も計算コストがかかるのが、入力全体を一度に読み込む最初の「Prefill」ステージです。入力が長ければ長いほど、このステージにかかる時間とメモリは増大します。Glyphは、入力をはるかに小さな画像トークンの集合に圧縮することで、このPrefillステージを大幅に高速化します 1。

この技術は、画像内の文字を認識・解釈する能力(OCR能力)を持つ現代の高性能なVLMの存在によって支えられています。Glyphは、VLMがテキストを視覚情報として捉える能力を逆手に取り、長文処理のボトルネックを解消する新しい道を切り開いたのです。

thu-coai/Glyphを支える技術

Glyphの革新的なアイデアは、それを実現するための具体的な技術基盤の上に成り立っています。ここでは、モデルのアーキテクチャからレンダリングの仕組み、そしてその性能に至るまで、技術的な詳細を掘り下げていきます。

モデルアーキテクチャ

Glyphフレームワークの中核をなすのは、GLM-4.1V-9B-Baseという強力なVLMです 1。このモデルが、レンダリングされたテキスト画像を処理し、内容を理解する役割を担います。このベースモデルは、さらにzai-org/GLM-4-9B-0414から派生したものであり、テキストと画像の両方を扱えるマルチモーダルな能力を備えています 1。つまり、Glyphは既存の強力なVLMをバックボーンとして活用し、その上に視覚的テキスト圧縮という新しい概念を実装しているのです。

レンダリングプロセス:圧縮と性能のトレードオフ

テキストを画像に変換するプロセスは、単なるスクリーンショットを撮るような単純なものではありません。レンダリング設定のパラメータが、モデルの性能に直接的な影響を与えます。特に重要なのがDPI(Dots Per Inch)、つまり画像の解像度です。DPIは、圧縮率と性能の間のトレードオフを制御する重要なレバーとなります 1。

- DPI=72: この設定では、テキストがよりコンパクトに描画されるため、高い圧縮率(平均3~4倍)を達成できます。しかし、解像度が低い分、文字の認識精度がわずかに低下し、モデルの性能に影響を与える可能性があります。開発者によると、これが圧縮率と性能の最も良いバランスを取れる設定とされています 1。

- DPI=96: こちらは解像度が高くなるため、圧縮率(平均2~3倍)は低下します。しかし、文字がより鮮明に描画されるため、VLMがテキストを正確に読み取りやすくなり、一般的にDPI=72よりも高い性能を発揮します 1。

このように、ユーザーはユースケースに応じて、速度と圧縮率を優先するか、最高の精度を求めるかを選択できます。このレンダリング設定の重要性は、Glyphの性能が単にVLMの知性だけでなく、入力データである「画像」の品質、つまり機械にとっての「読みやすさ」にも依存することを示唆しています。これは、純粋なテキストモデルには存在しなかった新しい最適化の次元であり、将来的に「AIの視覚に最適化されたテキストレンダリング手法」という研究分野が生まれる可能性すら秘めています。

パフォーマンスとベンチマーク

Glyphは、そのユニークなアプローチにもかかわらず、既存の長文コンテキストモデルと比較して競争力のある性能を達成しています。特に、LongBenchやMRCRといった長文読解能力を測る標準的なベンチマークにおいて、優れた結果を示しています 1。

さらに、シーケンス長が長くなるほど、テキストのみを処理するバックボーンモデルと比較して、推論速度が大幅に向上することも報告されています 1。これは、前述のPrefillステージの最適化が効果的に機能している証拠です。

実用化に向けた高速化

研究レベルのコンセプトに留まらず、Glyphは実用的なアプリケーションでの利用も視野に入れています。その証拠に、モデルはvLLMによる高速化をサポートしています 1。vLLMは、LLMの推論を最適化するための広く使われているライブラリであり、これをサポートすることで、長文コンテキストを扱うリアルタイムアプリケーションで求められる高いスループットと低い応答時間を実現することが可能になります。

「Glyph」ファミリー:視覚テキストAIの全体像を理解する

AI技術、特にテキストと画像の領域を調査していると、「Glyph」という名前を持つ複数のプロジェクトに遭遇します。これらはすべて「テキストの視覚的表現」に関連していますが、その目的と技術は大きく異なります。この混同を解き明かし、各プロジェクトの位置づけを明確にすることは、この分野の最先端を理解する上で不可欠です。

「もう一つのGlyph」たち:画像生成におけるテキスト描画

thu-coai/Glyphがテキストを理解するための入力技術であるのに対し、もう一つの大きな研究の流れは、画像の中にテキストを生成するための出力技術に焦点を当てています。これは、多くの人が体験したことのある「画像生成AIは文字を書くのが下手(スペルミスをする)」という問題を直接解決しようとする試みです。この分野で中心的な役割を果たしているのがGlyph-ByT5とGlyph-SDXLです。

Glyph-ByT5 & Glyph-SDXL:AIに正しいスペルを教える

- 目的: Stable Diffusion XL (SDXL) のような拡散モデルが、画像内に正確で、文脈に合った、複数行にわたる美しいテキストをレンダリングできるようにすること 2。

- 核心技術: 画像生成モデルが通常使用する、スペルの概念を持たないテキストエンコーダ(CLIPなど)を、Glyph-ByT5と呼ばれるカスタムエンコーダに置き換える点にあります 4。

-

ByT5の強み: ByT5は「トークナイザフリー」モデルであり、単語を意味の塊(トークン)に分割するのではなく、テキストを直接UTF-8バイトのシーケンスとして扱います。これにより、モデルは個々の文字を認識する能力(character awareness)を本質的に備えています。単語を

["un", "forget", "able"]のように分割してしまう従来のBPEトークナイザでは失われてしまうスペル情報が、ByT5では保持されます 6。 - 学習方法: Glyph-ByT5は、文字の視覚的表現(グリフ)とそのテキストをペアにした大規模なデータセットを用いてファインチューニングされます。これにより、文字を認識するテキスト埋め込みと、その文字が実際にどのように見えるかを強力に結びつけます 2。

- 成果: このアプローチにより、テキストレンダリングの精度は20%未満から90%近くまで劇的に向上しました 2。最新版のGlyph-ByT5-v2では、対応言語が10言語に拡大され、生成される画像の美的品質も向上しています 8。

GlyphDiffusion:テキスト生成を画像生成として捉える

- 目的: 条件付きテキスト生成のための新しいアプローチを提案すること 11。

- 核心技術: テキスト生成タスクそのものを、画像生成タスクとして再定義します。まず拡散モデルが目標とするテキストの「グリフ画像」を生成し、その後、別のモジュールがその生成された画像からテキストを抽出するというユニークな2段階のプロセスを経ます 11。これにより、連続的なデータを扱うのが得意な拡散モデルを、離散的なテキスト生成の領域に適用することが可能になります。

「Glyph」AIプロジェクトの比較

これらのプロジェクトの違いを明確にするため、以下の表にその特徴をまとめます。この表は、「Glyph」というキーワードで情報を探す際の羅針盤となり、各技術がどの問題を解決するために設計されたのかを一目で理解する助けとなるでしょう。

| プロジェクト名 | 主な目的 | 核心技術 | 解決する問題 |

thu-coai/Glyph | 長文コンテキストの理解 | テキストから画像へのレンダリング + 視覚言語モデル(VLM) | LLMのコンテキストウィンドウの効率的なスケーリング、計算コストの削減 |

Glyph-ByT5 / Glyph-SDXL | 画像内への正確なテキスト生成 | 文字認識可能なテキストエンコーダ(ByT5) + 拡散モデル(SDXL) | 画像生成AIにおけるスペルミスや不正確なテキスト描画 |

GlyphDiffusion | 新しいテキスト生成手法 | 拡散モデルによる「グリフ画像」生成と、その後のテキスト抽出 | 連続的な拡散モデルを離散的なテキスト生成領域へ応用 |

根本原因:なぜAIはテキストの扱いが苦手なのか?

「Glyph」ファミリーに属する多様なプロジェクトが生まれた背景には、従来のAIモデルがテキストを扱う上で抱える、より深く、根本的な問題が存在します。これらの問題を理解することは、Glyphたちがなぜ必要とされ、どのように機能するのかを真に理解するための鍵となります。

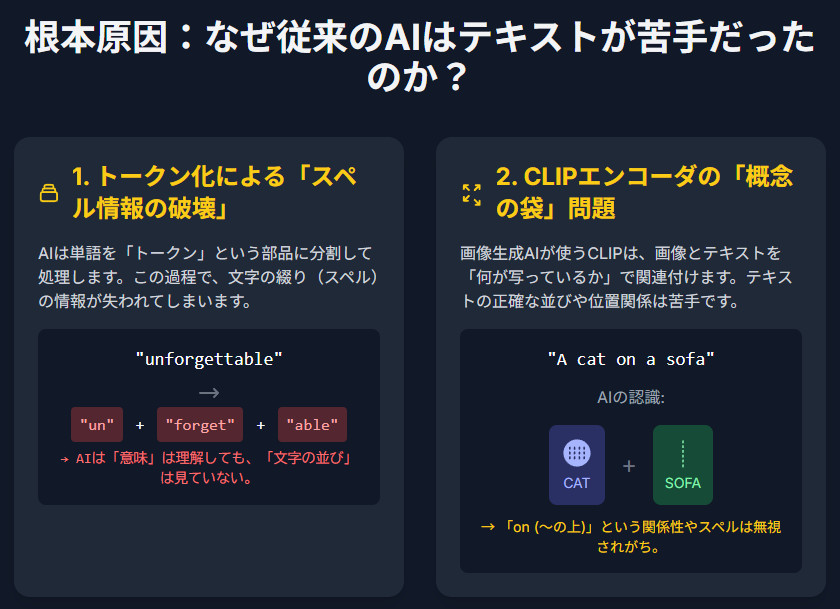

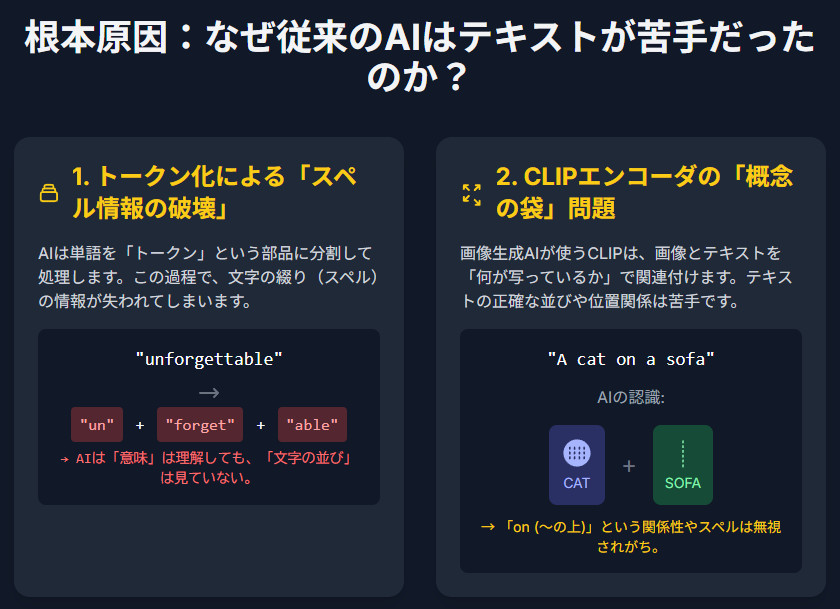

トークン化の問題点

ほとんどのLLMや画像生成モデルは、テキストを直接処理しているわけではありません。まず「トークナイザ」と呼ばれるプログラムを使って、文章をモデルが扱いやすい単位(トークン)に分割します。このプロセスで広く使われているのが、BPE(Byte-Pair Encoding)などの手法です。

例えば、「unforgettable」という単語は、["un", "forget", "able"]のようなトークンに分割されることがあります。この方法は、言語の統計的パターンを効率的に学習するには非常に有効ですが、その過程で綴り(オーソグラフィ)に関する情報を破壊してしまいます 15。モデルはトークン間の関係性を学習しますが、そのトークンがどのような文字で構成されているかという知識は失われるのです。これが、LLMに単語を逆から綴らせたり、アナグラムのような言葉遊びをさせたりするのが難しい理由の一つです。AIは「意味」は理解できても、「文字の形」そのものを見ていないのです。

CLIPテキストエンコーダの限界

画像生成AI、特にStable Diffusionのようなモデルで標準的に使われているのが、CLIPというテキストエンコーダです。CLIPは、画像全体の内容と、それに付随するキャプション(短い説明文)を結びつけるように学習されています 6。しかし、この設計がテキスト描画においていくつかの深刻な限界を生み出しています。

- 「概念の袋(Bag of Words)」としての理解: CLIPは、画像に「猫」と「ソファ」が含まれていることは理解できますが、「猫がソファの上にいる」といった正確な空間的関係性を捉えるのは苦手です。同様に、画像内のテキストを、構造化された文字の並びとしてではなく、単なる視覚的なテクスチャや模様の一つとして認識してしまいます 18。AIにとって、プロンプト内の「Apple」という文字は、リンゴという果物の概念であり、A, P, P, L, Eという5つの文字の並びではないのです。

- 短いコンテキスト長の制約: CLIPは、設計上77トークンという厳格な入力長制限を持っています。さらに、学習データのほとんどが短いキャプションであったため、実質的に有効なのは20トークン程度に過ぎないという研究結果もあります 18。このため、CLIPは原理的に長い文字列を生成したり、正確に綴ったりすることができません。

問題と解決策の結びつき

これらの根本原因が、Glyphプロジェクト群の必要性を直接的に示しています。

-

トークン化とCLIPの限界こそが、正確なテキスト生成のために

Glyph-ByT5のような文字認識可能なエンコーダを必要とする理由です。 -

長いトークンシーケンスを処理する際の膨大な計算コストこそが、効率的なテキスト理解のために

thu-coai/Glyphのような視覚的圧縮アプローチを必要とする理由です。

この流れは、AIにおける言語の扱いの進化を示唆しています。初期のモデルは、統計的効率のために言語を「トークン」という抽象的な概念に置き換えました。しかし、その抽象化によって失われた情報(スペルや視覚的レイアウト)が、新たな課題を生み出しました。「Glyph」ファミリーの登場は、その失われた物理的・視覚的・構造的特性をモデルに再導入し、抽象化の限界を乗り越えようとする、いわば「言語の再具体化」の動きと捉えることができるでしょう。

限界と今後の可能性

thu-coai/Glyphは長文コンテキスト処理に革命をもたらす可能性を秘めていますが、他の先進技術と同様に、現時点での限界と、それを乗り越えた先にある広大な可能性の両面を持っています。

thu-coai/Glyphの現在の限界

- レンダリング設定への感度: 前述の通り、モデルの性能はDPIなどのレンダリング設定に大きく依存します。これは、学習データで使われたフォントやレイアウトと大きく異なる形式のテキストに対しては、性能が低下する可能性があることを意味します 1。未知の視覚スタイルへの汎化能力は、今後の課題の一つです。

- OCR関連の課題: VLMは驚異的な文字認識能力を持ちますが、完璧ではありません。特に、UUID(汎用一意識別子)のようなランダムで珍しい英数字の羅列や、非常に細かい文字の認識には依然として課題が残ります。これにより、時折、文字の誤認識が発生する可能性があります 1。これは、従来のOCRシステムが共通して抱える問題でもあります。

- 限定的な汎化能力: このモデルは、長文コンテキストの理解という特定のタスクに特化して学習されています。そのため、一般的な質問応答や画像キャプション生成といった、より広範なVLMタスクにおける能力はまだ十分に検証されていません 1。

未来への展望

これらの限界を踏まえつつも、Glyphが切り開く未来は非常に広大です。

- テキストを超えて: この視覚的圧縮アプローチは、テキスト以外のシーケンシャルデータにも応用できる可能性があります。例えば、ソフトウェアのソースコード、ゲノム配列、あるいは金融市場の時系列データなどを画像としてレンダリングし、VLMにその全体的なパターンや構造を分析させることが考えられます。

-

理解と生成の融合:

thu-coai/Glyphの長文理解能力と、Glyph-SDXLの正確なテキスト描画能力を組み合わせることで、究極の「読み書きができるAI」が誕生するかもしれません。例えば、一冊の本を丸ごと読み込ませ、その内容に基づいたイラストと、本からの正確な引用文を画像内に生成するといったタスクが可能になるでしょう。 - ハードウェアへの影響: このアプローチは、LLMの計算負荷が高い注意機構から、より効率的なVLMの視覚処理へと計算のボトルネックをシフトさせます。これにより、将来的には、それほど高性能ではないハードウェア上でも、強力な長文分析が可能になるかもしれません。

結論:AIとテキストの新たな関係性の幕開け

thu-coai/Glyphがもたらした最も重要な貢献は、長年にわたるAI研究の大きな課題であった「長文コンテキスト問題」を、トークンシーケンスの処理という1次元の挑戦から、マルチモーダルな視覚処理という2次元の挑戦へと見事に再定義した点にあります。このパラダイムシフトは、単なる性能向上に留まらず、AIが情報をどのように認識し、処理するかの未来像を提示しています。

さらに、この動きはthu-coai/Glyph単独のものではありません。Glyph-ByT5やGlyphDiffusionを含む広範な「Glyph」ムーブメントは、AIをより「読み書きが得意(literate)」にするための大きな潮流の一部です。これらの技術は、テキストを単なる意味の連なりとしてではなく、その視覚的な形式も含めて全体的に捉えることの重要性を示しています。これにより、AIは入力(理解)と出力(生成)の両面で、テキストとの関わり方を根本的に変えつつあります。

今後も、多くのタスクにおいてトークンベースの処理が主流であり続けることは間違いないでしょう。しかし、「Glyph」ファミリーが示した技術群は、AI開発における新しく、そして極めて強力な選択肢を提示しました。それは、情報の「内容」を理解することと同じくらい、その「形式」を理解することが重要となる未来です。Glyphの登場は、AIとテキストの新たな関係性の時代の幕開けを告げるものと言えるでしょう。

参考資料

- Glyph: Scaling Context Windows via Visual-Text Compression, https://github.com/thu-coai/Glyph

- zai-org/Glyph, https://huggingface.co/zai-org/Glyph/

- GlyphDiffusion: Text Generation as Image Generation, https://arxiv.org/abs/2304.12519

- Glyph-ByT5: A Customized Text Encoder for Accurate Visual Text Rendering, https://github.com/AIGText/Glyph-ByT5

- Glyph-ByT5: A Customized Text Encoder for Accurate Visual Text Rendering (Paper), https://arxiv.org/html/2403.09622v1

- Glyph-ByT5-v2: A Strong Aesthetic Baseline for Accurate Multilingual Visual Text Rendering, https://glyph-byt5-v2.github.io/

- Why AI fails with text inside images, and how it could change, https://medium.com/@markus_brinsa/why-ai-fails-with-text-inside-images-and-how-it-could-change-b0ed18cd5a18

- ByT5: Towards a token-free future with pre-trained byte-to-byte models, https://www.reddit.com/r/MachineLearning/comments/1kds7un/d_why_do_image_generation_models_struggle_with/

- Understanding OpenAI’s CLIP model, https://medium.com/@paluchasz/understanding-openais-clip-model-6b52bade3fa3

- Long-CLIP: A New CLIP Model for Long-Text-to-Image Generation, https://www.digitalocean.com/community/tutorials/long-clip-zero-shot-classification-text-analysis

コメント