Gemma 4がいよいよ登場!初心者でもわかる、Googleの最新AIで広がる未来の可能性のPodcast

下記のPodcastは、Geminiで作成しました。

はじめに

2026年4月2日、Google DeepMindは、同社が提供するオープンウェイトモデルの最新世代となる「Gemma 4」を公式に発表しました 。この発表は、人工知能(AI)の世界において非常に重要な意味を持っています。なぜなら、これまで専門家や大企業のものだと思われていた「最先端の推論能力」や「マルチモーダル機能(画像や音声を理解する力)」が、私たちの手元にあるスマートフォンやノートパソコン、あるいは小さな電子基板の上で、完全にオフラインで動かせるようになったからです 。Gemma 4は、Googleの商用フラッグシップモデルである「Gemini 3」と同じ研究基盤と技術を用いて構築されており、その性能は前世代のGemma 3から驚異的な飛躍を遂けています 。

このレポートでは、AIに詳しくない初心者の方でもGemma 4の凄さがわかるように、その特徴や仕組み、および私たちの生活や仕事がどのように変わるのかを丁寧に解説していきます。

4つのモデル:用途に合わせて選べるサイズ

Gemma 4は、使う道具や目的に合わせて4つの異なるサイズが用意されています 。これは、まるでお店で服のサイズを選ぶように、自分の持っているコンピュータの性能に合わせて最適なAIを選べるということです 。

エッジティア:スマートフォンやIoTデバイス向け

「Effective 2B (E2B)」と「Effective 4B (E4B)」の2種類は、非常にコンパクトに設計されています 。これらはスマートフォン(特にAndroid端末)や、Raspberry Pi(ラズベリーパイ)のような小型の教育用コンピュータ、あるいはNVIDIA Jetsonのような組み込みデバイスで動かすことを想定しています 。驚くべきことに、これらの小さなモデルでもテキストだけでなく画像や動画、さらには音声まで直接理解することができます 。

ワークステーションティア:開発者や高性能PC向け

より高度な作業を行いたい場合には、「26B Mixture of Experts (MoE)」と「31B Dense」という2つの大型モデルが用意されています 。これらはノートパソコンのGPU(画像処理装置)や、データセンターにある強力なサーバーで動作します 。特に31Bモデルは、オープンソースのAIモデルとしては世界第3位にランクインするほどの極めて高い知能を持っています 。

Gemma 4 モデルファミリーの一覧

| モデル名 | 推論時の計算量(実効パラメータ数) | 総パラメータ数 | 対応する主な端末 | 主な特徴 |

| Gemma 4 E2B | 約23億 | 約50億 | スマートフォン、IoT機器 | 高速動作、音声入力対応、省電力 |

| Gemma 4 E4B | 約45億 | 約80億 | 高性能スマホ、ノートPC | 高い推論力と軽快さの両立、音声対応 |

| Gemma 4 26B MoE | 約38億(動作時) | 約252億 | RTX搭載PC、サーバー | 超低遅延、複数タスクの同時処理に強い |

| Gemma 4 31B Dense | 約307億 | 約307億 | ハイエンドワークステーション | 最高の推論精度、数学・コーディング特化 |

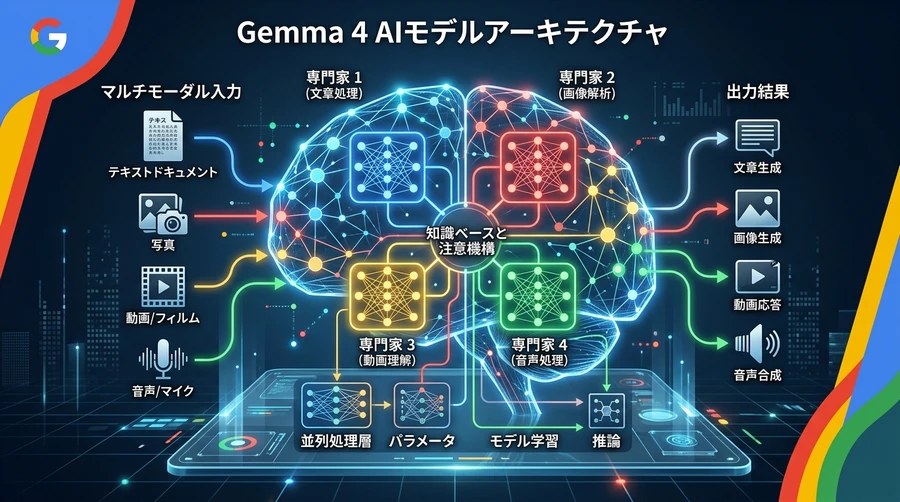

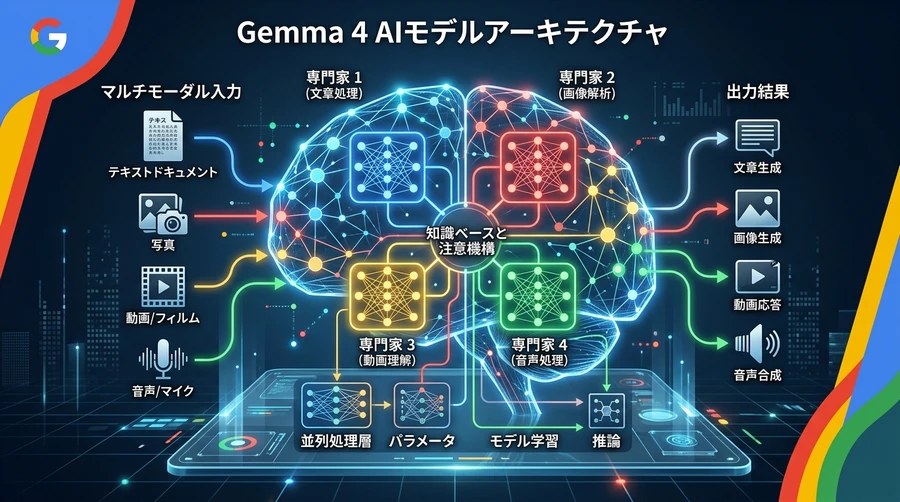

Gemma 4を支える魔法の技術

Gemma 4が、なぜこれほどまでに小さくて賢いのか。そこにはGoogle DeepMindが開発した「静かな革新」と呼ばれる新しい技術が詰め込まれています 。

PLE:層ごとに情報を伝える仕組み

その代表的な技術が「Per-Layer Embeddings (PLE)」です 。これまでのAIは、最初に入力された言葉の意味を一度だけ解釈して、それを最後まで使い回していました。しかしPLEを採用したGemma 4は、AIの内部にある「層」ごとに、その時々に必要な情報を少しずつ補給する仕組みを持っています 。これにより、モデルのサイズを大きくすることなく、情報の表現力を大幅に高めることに成功しました 。

MoE:専門家チームによる協力体制

26B MoEモデルに採用されている「Mixture of Experts (MoE)」という仕組みも非常にユニークです 。これは、AIの中に128人の「小さな専門家」を抱えているようなものです 。何かの命令が下されたとき、その内容に合わせて最適な8人の専門家だけが選ばれて働きます 。260億近いパラメータを持ちながら、実際に働くのはその一部(約40億)だけなので、非常に賢いのに動きは軽い、という理想的な状態を実現しています 。

ハイブリッドアテンションとDual RoPE

長い文章を読み取る際、AIはしばしば前の内容を忘れてしまうことがあります。Gemma 4は「ハイブリッドアテンション」という仕組みでこれを解決しています 。近くの言葉を素早く読み取る層と、文章全体を俯瞰して読み取る層を交互に配置することで、最大256,000トークン(一般的な書籍数冊分に相当)という広大な記憶範囲を確保しました 。また、情報の位置を正確に把握する「Dual RoPE」技術により、長い文章の途中に書かれた細かい情報も正確に取り出すことができます 。

驚異的な性能向上:AIが「じっくり考える」時代へ

Gemma 4の最も目に見える変化は、その「思考力」にあります。今回、新しく導入された「Thinking Mode(思考モード)」により、AIは答えを出す前に、自分の中で論理的なステップを組み立てて「考える」プロセスを行うようになりました 。

ベンチマークが示す圧倒的な実力

数学やプログラミングの難問を解かせるテスト(ベンチマーク)では、前世代から信じられないほどのスコア上昇が見られます 。

| テスト項目 | 内容 | Gemma 4 31B (最新) | Gemma 3 27B (前世代) |

| AIME 2026 | 超難関の数学オリンピック級問題 | 89.2% | 20.8% |

| LiveCodeBench v6 | 競技プログラミングのコーディング力 | 80.0% | 29.1% |

| GPQA Diamond | 大学院レベルの科学的推論 | 84.3% | 42.4% |

| MMMU Pro | 画像を含む複雑な視覚推論 | 76.9% | 49.7% |

この数値が示すのは、単なる改良ではなく、もはや「別次元の知能」になったということです 。特に数学のスコアが20%から89%へと跳ね上がったのは、この「思考モード」が論理的なステップを一段ずつ踏むことで、ミスを劇的に減らした結果です 。

コーディングとエージェント機能

Gemma 4は、単に会話を楽しむだけでなく、「自律的に動くエージェント」としての能力が強化されています 。例えば、プログラミングにおいて、AIがあなたの代わりにコードを書き、そのコードに間違いがないか自分でテストし、修正を繰り返すといった作業が可能です 。これはAndroid Studioの「Agent Mode」として提供されており、開発者はインターネットに繋がなくても、自分のパソコンの中だけで高度なAIアシスタントの恩恵を受けることができます 。

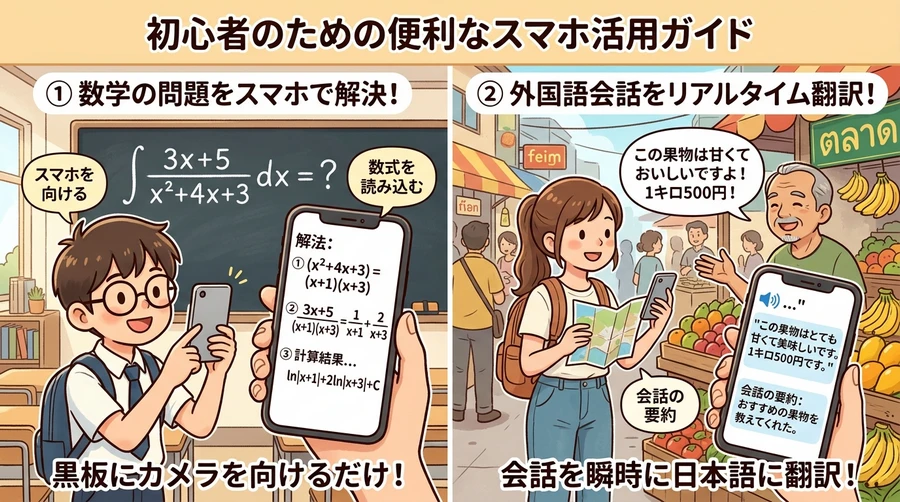

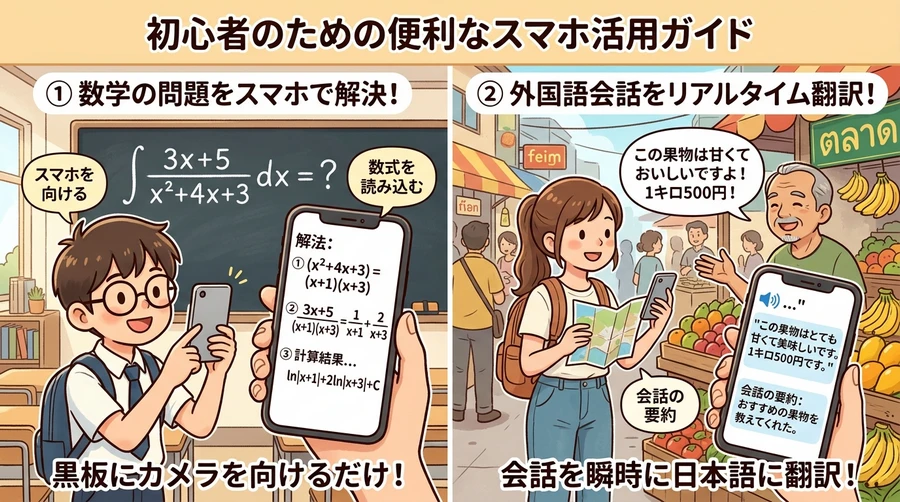

何でもこなす「マルチモーダル」の力

Gemma 4は、目と耳を持ったAIです 。全てのモデルで画像と動画をそのまま処理でき、特に小さなモデル(E2B, E4B)では音声入力にも対応しています 。

視覚:画像や図表を読み解く

スマートフォンのカメラで撮影した写真の中にある文字を読み取る(OCR)のはもちろん、複雑なグラフやチャートを分析して、その意味を言葉で説明してくれます 。手書きの数式を解いたり、PDFの書類を読み込んで要約したりすることも、デバイスの中で完結します 。動画についても、最大60秒間の映像をコマ送りのように理解し、何が起きているかを把握できます 。

聴覚:音声を聞いてそのまま翻訳・理解

小さなモデルに搭載された「USMスタイルコンフォーマー」という技術により、音声を直接AIが聞き取ることができます 。これにより、他人の話している外国語をリアルタイムで翻訳したり、録音した会議の内容をその場で要約したりといったことが、プライバシーを守りながら(クラウドにデータを送らずに)実行できるようになります 。

自由と安心:Apache 2.0 ライセンスへの移行

今回の発表で、技術と同じくらい注目を集めたのが「ライセンス(利用規則)」の変更です 。

Gemma 4は、これまでのGoogle独自の規約を捨て、世界中で広く認められている「Apache License 2.0」を採用しました 。これは、開発者や企業にとって非常に嬉しいニュースです。なぜなら、このライセンスによって、AIを商用利用(ビジネスで使うこと)したり、自由に改造したり、改造したものを再配布したりすることが、ほとんど制限なく認められるようになったからです 。

データの主権を守る「ローカルAI」

インターネット上のサービスを利用すると、自分のデータがどこかの会社のサーバーに送られてしまいます。しかしGemma 4のようにローカル(自分の手元の端末)で動くAIなら、データは一切外に出ません 。

- 医療: 患者さんの個人情報を守りながらAIで診断を支援する 。

- ビジネス: 企業の機密情報(コードや契約書)をクラウドに上げずに分析する 。

- 教育: 子供の学習履歴を外部に漏らさず、パーソナライズされた指導を行う。

このように、プライバシーが最も重要視される場面において、Gemma 4は強力な味方となります 。

Gemma 4を使ってみよう!初心者のための始め方

「AIを自分のパソコンで動かすなんて難しそう……」と思うかもしれませんが、2026年現在、驚くほど簡単に使い始められるツールが揃っています 。

1. Ollama(オラマ)を使う方法

最もおすすめなのが、Ollamaというツールを使う方法です 。

- 公式サイト(ollama.com)からアプリをダウンロードしてインストールします 。

- コマンド(またはメニュー)から

ollama run gemma4:e2bと打ち込むだけです 。 これだけで、あなたのパソコンの中に最新のGemma 4がやってきます。E2Bモデルなら、一般的なノートパソコンで驚くほどキビキビと動きます 。

2. Android Studio で開発に使う方法

もしあなたがアプリ開発に興味があるなら、最新のAndroid Studioをダウンロードしてください 。設定画面から「Gemma 4」をモデルプロバイダーとして選ぶだけで、あなたのコーディングを助けてくれる優秀なAIパートナーが動き出します 。

ハードウェア選びの目安

AIを動かすために必要なメモリ(RAM)の量は、モデルのサイズによって異なります 。

| モデル | 必要なメモリの目安(4ビット圧縮時) | 推奨する環境 |

| E2B | 1.5 GB 未満 | スマートフォン、Raspberry Pi 5 |

| E4B | 約 3 GB | 一般的なノートパソコン (RAM 8GB〜) |

| 26B MoE | 約 18 GB | 高性能ゲーミングPC (GPU搭載) |

| 31B Dense | 約 20 GB | 開発者用ワークステーション |

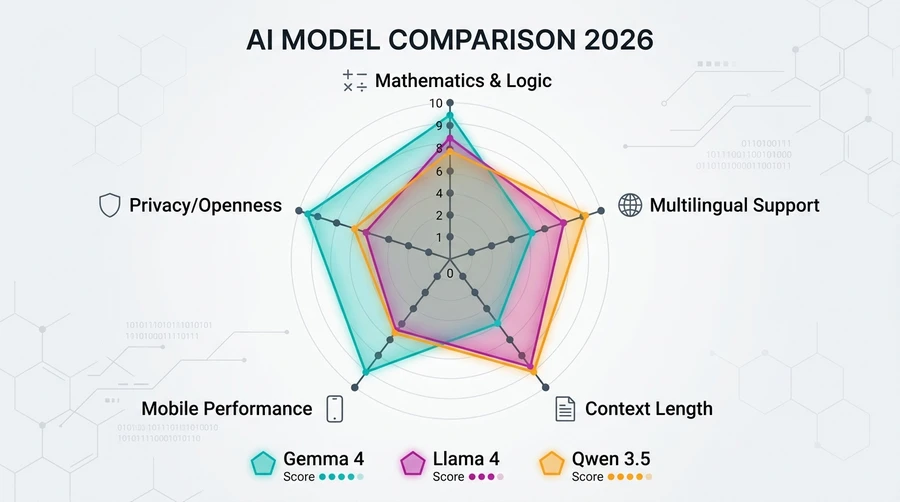

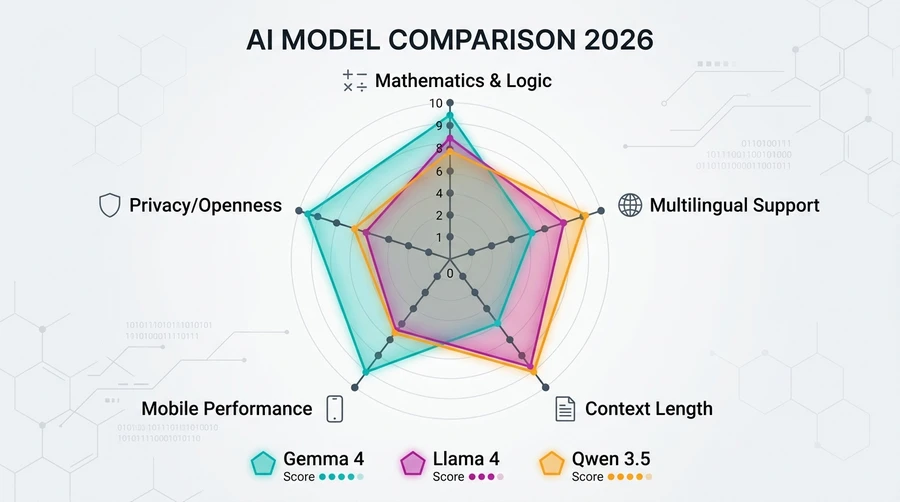

他のAIと何が違うの?ライバルとの比較

2026年は、Gemma 4以外にも優れたAIがたくさん登場しています 。自分にぴったりのAIを選ぶためのヒントをまとめました。

- Llama 4 Scout (Meta): 「とにかく大量の書類を一気に読ませたい」場合に最適です。1,000万トークンという、世界最長の記憶範囲を持っています 。

- Qwen 3.5 (Alibaba): 「中国語や多言語での正確なやり取りが必要」な場合に強いです。語彙数が非常に多く、アジア圏の言語に精通しています 。

- Gemma 4 (Google): 「バランスの良さと知能の高さ、およびデバイス上での使いやすさ」で選ぶならこれです 。特に数学や論理パズル、プログラミングにおいては、このサイズ帯で最高の性能を発揮します 。

まとめ:Gemma 4が切り拓く新しい日常

Gemma 4の登場によって、AIはもはや「遠くの雲の上にある巨大な脳」ではなく、「ポケットの中や机の上にある、あなただけのパートナー」になりました 。

- オフラインで安心: 飛行機の中や電波の届かない場所でも、AIがあなたを助けてくれます 。

- プライバシーの保護: あなたの個人的な会話や大切なデータが外部に漏れる心配はありません 。

- 圧倒的な知能: これまではスーパーコンピュータが必要だったような高度な推論が、小さなチップの上で動き始めました 。

Googleがこの高性能なモデルを「Apache 2.0」という極めて自由なライセンスで公開したことは、世界中のクリエイターやエンジニアが、より安全で便利な未来を創るための強力な翼を手に入れたことを意味します 。初心者のみなさんも、まずはスマートフォンやパソコンで、この「小さな魔法」に触れてみてはいかがでしょうか。AIが「じっくり考え」、私たちの目や耳となってくれる新しい体験が、すぐそこまで来ています 。

参考資料

- Google launches open model Gemma 4,(https://news.cgtn.com/news/2026-04-03/Google-launches-open-model-Gemma-4-1M2WodjFYw8/p.html)

- Google on Thursday unveiled Gemma 4, its most capable family of open-weight models to date, https://www.eweek.com/news/google-gemma-4-apache-2-open-models/

- Gemma is a series of open-source large language models developed by Google DeepMind, https://en.wikipedia.org/wiki/Gemma_(language_model

- Gemma 4, with four being the generation reference in the name, is available in four model sizes as well, https://www.hindustantimes.com/business/gemma-4-imbibes-google-s-sharpest-ai-instincts-and-is-more-welcoming-101775187802869.html

- Google launches Gemma 4, a new open-source model: How to try it, https://mashable.com/article/google-releases-gemma-4-open-ai-model-now-open-source-how-to-try-it

- Google on Thursday announced Gemma 4, a new generation of open models designed for advanced reasoning and agentic workflows, https://english.news.cn/northamerica/20260403/3c3bdb9b42054ebd887a5daf5a8cfa2c/c.html

- The Gemma 4 scores look very solid, the small models have incredible benchmark scores, https://www.interconnects.ai/p/gemma-4-and-what-makes-an-open-model

- Gemma 4 is said to master multi-step planning and complex logic tasks, https://www.trendingtopics.eu/google-gemma-4-launch/

- Gemma-4-E2B-IT seems to be as good or better than Qwen3.5-4B, https://www.reddit.com/r/LocalLLaMA/comments/1sb1gx0/gemma4e2bit_seems_to_be_as_good_or_better_than/

- Gemma 4 day 1 inference on NVIDIA DGX Spark preliminary benchmarks, https://forums.developer.nvidia.com/t/gemma-4-day-1-inference-on-nvidia-dgx-spark-preliminary-benchmarks/365503

- Gemma 4 vs Qwen 3.5 vs Llama 4 compared, https://ai.rs/ai-developer/gemma-4-vs-qwen-3-5-vs-llama-4-compared

- Gemma 4 model card, https://ai.google.dev/gemma/docs/core/model_card_4

- Gemma models overview, https://ai.google.dev/gemma/docs

- Google Gemma 4: Best Open AI Model in 2026?, https://www.buildfastwithai.com/blogs/google-gemma-4-open-model

- Google has launched Gemma 4, the latest and most capable version of its open-source AI model family, https://timesofindia.indiatimes.com/technology/tech-news/google-launches-gemma-4-for-data-centres-and-smartphones-what-ceo-sundar-pichai-and-demis-hassabis-have-to-say/articleshow/129988247.cms

- Today, we are introducing Gemma 4 — our most intelligent open models to date, https://blog.google/innovation-and-ai/technology/developers-tools/gemma-4/

- The latest Gemma 4 models are compatible with OpenClaw, https://blogs.nvidia.com/blog/rtx-ai-garage-open-models-google-gemma-4/

- Gemma 4 - How to Run Locally, https://unsloth.ai/docs/models/gemma-4

- What is Google Gemma 4?, https://wavespeed.ai/blog/posts/what-is-google-gemma-4/

- Today, we are releasing Gemma 4 on Google Cloud, https://cloud.google.com/blog/products/ai-machine-learning/gemma-4-available-on-google-cloud

- Gemma 4 31B IT is an open multimodal model built by Google DeepMind, https://build.nvidia.com/google/gemma-4-31b-it/modelcard

- What is new with Gemma 4?, https://huggingface.co/blog/gemma4

- Google Gemma 4 has been officially released, marking its first-ever release under the fully open-source Apache 2.0 license, https://help.apiyi.com/en/google-gemma-4-open-model-apache2-multimodal-guide-en.html

- The Gemma 4 Model Family, https://www.lushbinary.com/blog/gemma-4-developer-guide-benchmarks-architecture-local-deployment-2026/

- Use a local model in Android Studio, https://developer.android.com/studio/gemini/use-a-local-model

- Android Developers Blog: Gemma 4: The new standard for local agentic intelligence on Android, https://android-developers.googleblog.com/2026/04/gemma-4-new-standard-for-local-agentic-intelligence.html

- The 31B Dense model scores 89.2% on AIME 2026, https://www.eweek.com/news/google-gemma-4-apache-2-open-models/

- How do I download and run Gemma 4 with Ollama?, https://www.buildfastwithai.com/blogs/google-gemma-4-open-model

- Gemma 4 is available in four variants designed for different compute and deployment needs, https://www.fonearena.com/blog/479059/google-gemma-4-features.html

- Bring state-of-the-art agentic skills to the edge with Gemma 4, https://developers.googleblog.com/bring-state-of-the-art-agentic-skills-to-the-edge-with-gemma-4/

- Open-Source Models (Free / Self-Hostable) 2026, https://www.grandlinux.com/en/blogs/ai-model-comparison.html

- Top 5 local LLM tools and models, https://pinggy.io/blog/top_5_local_llm_tools_and_models/

- Open source LLM comparison, https://till-freitag.com/en/blog/open-source-llm-comparison

- Gemma 4 vs Mistral Small 3.1,(https://sourceforge.net/software/compare/Gemma-4-vs-Mistral-Small-3.1/)

- Open LLM Leaderboard, https://onyx.app/open-llm-leaderboard

- ベンチマークの詳細分析,(https://qiita.com/TaichiEndoh/items/0b06c96326e0f41912b1)

- Gemma 4 beginners use cases examples for non-coders, https://ai.google.dev/gemma/docs/core/model_card_4

- Gemma 4 on Android comes in two sizes,(https://android-developers.googleblog.com/2026/04/AI-Core-Developer-Preview.html)

- Gemma 4 Prompt Formatting, https://ai.google.dev/gemma/docs/core/prompt-formatting-gemma4

- Industry-leading capabilities and mobile-first AI, https://deepmind.google/blog/gemma-4-byte-for-byte-the-most-capable-open-models/

- Google Gemma 4 fully open source powerful local AI, https://www.zdnet.com/article/google-gemma-4-fully-open-source-powerful-local-ai/

- Bring state-of-the-art agentic skills to the edge with Gemma 4 (Developer Blog), https://developers.googleblog.com/bring-state-of-the-art-agentic-skills-to-the-edge-with-gemma-4/

- Gemma 4 is a family of open language models based on the same research foundation as the proprietary Gemini 3 model, https://www.trendingtopics.eu/google-gemma-4-launch/

- Google previews Gemini Nano 4 for Android AICore, https://9to5google.com/2026/04/02/gemini-nano-4-android/

- The Google Gemma 4 architecture includes Per-Layer Embeddings and Shared KV Cache, https://www.buildfastwithai.com/blogs/google-gemma-4-open-model

- Gemma 4 vs Llama 4 vs Qwen 3.5 benchmark comparison details, https://ai.rs/ai-developer/gemma-4-vs-qwen-3-5-vs-llama-4-compared

- Google officially introduced Gemma 4 on April 02, 2026, https://blog.google/innovation-and-ai/technology/developers-tools/gemma-4/

コメント